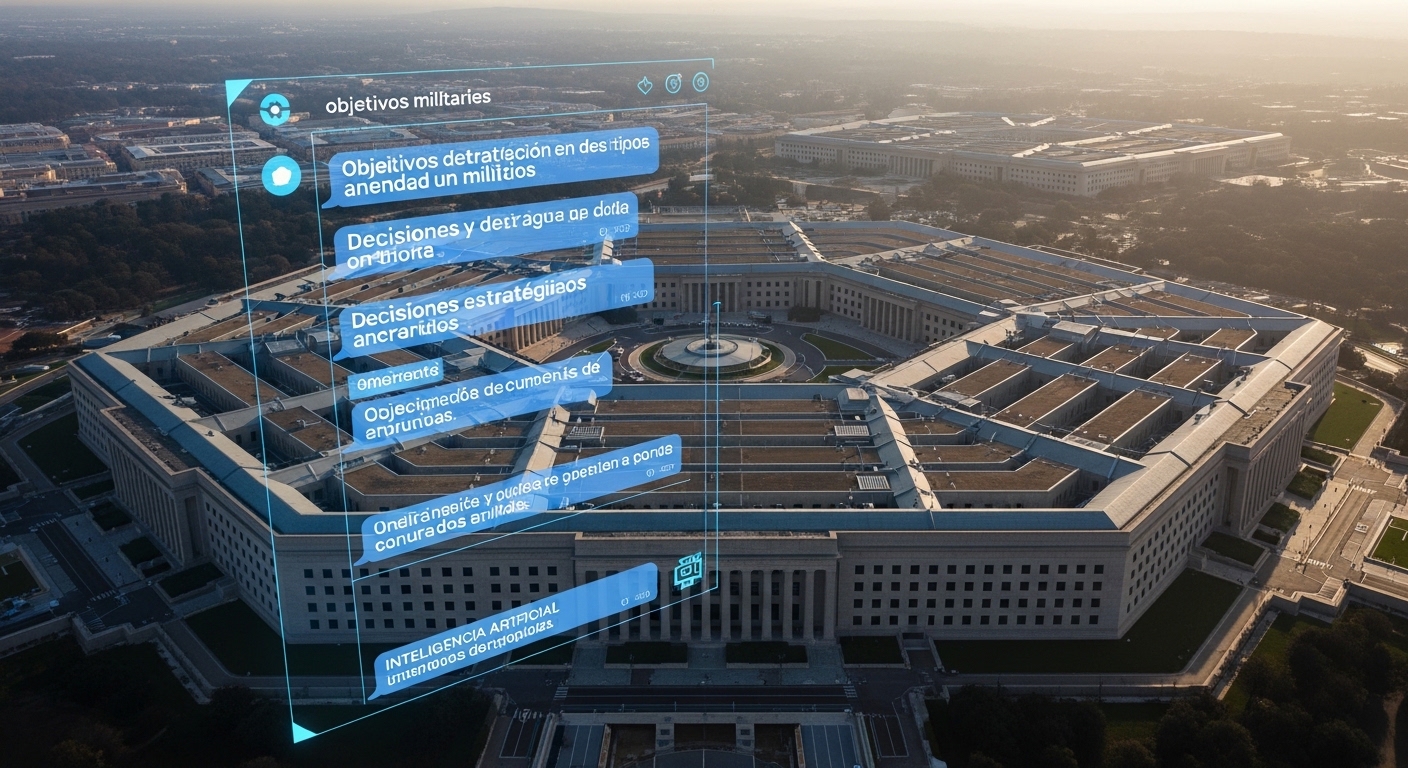

Pentágono y la IA: Chatbots para Decisiones de Objetivos Militares

Pentágono y la IA: Chatbots para Decisiones de Objetivos Militares

Con la precisión de los expertos en IA de EE.UU. y la innovación de México, iamanos.com te presenta los avances que están transformando la industria. Un funcionario del Departamento de Defensa de los Estados Unidos acaba de abrir una caja de Pandora tecnológica. La IA generativa podría clasificar listas de objetivos militares y recomendar cuáles atacar primero. No es ciencia ficción: es el debate más urgente de 2026.

El Testimonio que Cambió el Debate sobre la IA en Defensa

En marzo de 2026, un alto funcionario del Departamento de Defensa de los Estados Unidos reveló públicamente ante medios especializados —incluida MIT Technology Review— que el ejército estadounidense está evaluando activamente el uso de sistemas de centros-datos-ia-sostenible-2026/” target=”_blank” rel=”noopener noreferrer”>inteligencia artificial generativa para apoyar decisiones de selección de objetivos en operaciones militares. El funcionario describió un escenario donde un sistema de IA analiza listas de objetivos potenciales, los clasifica según criterios estratégicos y tácticos, y emite recomendaciones sobre el orden de prioridad para su neutralización. Todo esto, en teoría, bajo supervisión humana.

Este testimonio no es una filtración accidental. Es una señal deliberada de que el Pentágono está normalizando conversaciones sobre el uso de modelos de lenguaje en contextos de alta criticidad. Para cualquier director de tecnología o CEO que opera en sectores regulados, el mensaje es claro: la IA ya no es solo una herramienta de productividad. Es una herramienta de poder, y las decisiones que se tomen hoy sobre su gobernanza definirán los próximos veinte años.

Qué se entiende por “supervisión humana” en este contexto

El concepto de supervisión humana en sistemas de decisión militar es técnicamente complejo. En la práctica, significa que un instrucciones-modelos-lenguaje-seguridad-operador-2026/” target=”_blank” rel=”noopener noreferrer”>operador humano revisa la recomendación del modelo antes de ejecutar una acción. Sin embargo, los expertos en gobernanza de IA señalan que cuando un sistema genera una recomendación con alta confianza estadística, el sesgo de automatización lleva a los operadores humanos a aprobarla sin análisis crítico suficiente. **En 2026, estudios del Instituto Alan Turing indican que los operadores humanos aprueban las recomendaciones de sistemas de IA en hasta un 87% de los casos sin modificaciones, incluso en escenarios de entrenamiento con errores deliberados.** Esto plantea una pregunta incómoda: ¿es la supervisión humana real o meramente formal?

La arquitectura técnica detrás de un modelo de clasificación de objetivos

Desde una perspectiva de ingeniería, un sistema de este tipo probablemente combina tres capas: primero, un modelo de lenguaje de gran escala entrenado con doctrina militar, centros-datos-ia-sostenible-2026/” target=”_blank” rel=”noopener noreferrer”>inteligencia abierta y datos clasificados; segundo, un módulo de razonamiento estructurado que aplica criterios de priorización como amenaza inminente, valor estratégico y proporcionalidad; y tercero, una interfaz de instrucciones donde el analista humano introduce el contexto operacional en lenguaje natural. La salida es una lista ordenada con justificaciones textuales para cada recomendación. Esta arquitectura es funcionalmente idéntica a los sistemas multiagente que hoy usan empresas de logística para priorizar rutas o recursos. La diferencia es el dominio de aplicación y las consecuencias irreversibles de un error.

Los Riesgos Técnicos que Ningún General Quiere Escuchar

Los modelos de lenguaje generativo tienen limitaciones estructurales que en contextos civiles generan inconvenientes menores, pero en contextos militares pueden tener consecuencias catastróficas. La alucinación —la tendencia de estos modelos a generar información plausible pero incorrecta— es el riesgo más citado. Un sistema que alucina en una recomendación de selección de objetivos no produce un correo electrónico mal redactado: produce una justificación textualmente coherente para atacar el objetivo equivocado.

El segundo riesgo es la opacidad interpretativa. Los modelos de lenguaje de gran escala son, en esencia, cajas negras. Cuando un sistema recomienda priorizar un objetivo sobre otro, no existe una cadena lógica auditable de causa-efecto. Esto es incompatible con los principios básicos del derecho internacional humanitario, que exigen que las decisiones de uso de fuerza puedan ser justificadas y revisadas. Para los equipos jurídicos y de cumplimiento normativo de cualquier organización que trabaje con tecnología de defensa, esta opacidad representa un riesgo legal de primer orden.

El tercer riesgo es la manipulación adversarial. Como hemos analizado en profundidad en nuestro análisis sobre cómo blindar agentes de IA contra ataques de instrucciones, los sistemas de lenguaje son vulnerables a ataques de inyección de instrucciones. En un contexto militar, un actor adversario podría intentar manipular el contexto operacional ingresado al sistema para influir en sus recomendaciones.

El problema de la responsabilidad cuando la IA decide

El derecho internacional humanitario establece que siempre debe existir un responsable humano identificable por cada acción bélica. Cuando un modelo de lenguaje recomienda un objetivo y un instrucciones-modelos-lenguaje-seguridad-operador-2026/” target=”_blank” rel=”noopener noreferrer”>operador lo aprueba en segundos, ¿quién es responsable si la recomendación fue errónea? ¿El desarrollador del modelo? ¿El oficial que aprobó? ¿El Secretario de Defensa que autorizó el despliegue del sistema? Esta ambigüedad no es solo filosófica: tiene implicaciones directas en tratados internacionales, juicios por crímenes de guerra y la credibilidad diplomática de los Estados que adopten estas tecnologías. En iamanos.com trabajamos con clientes en sectores regulados donde la trazabilidad de las decisiones de IA es un requisito no negociable, y la ausencia de este mecanismo en sistemas militares es, desde nuestra perspectiva técnica, la vulnerabilidad más grave de toda esta arquitectura.

Sesgo algorítmico en datos de entrenamiento con origen en conflictos históricos

Si un modelo es entrenado con datos históricos de inteligencia militar, hereda inevitablemente los sesgos de las operaciones pasadas. Esto puede incluir patrones discriminatorios en la clasificación de amenazas basados en geografía, etnicidad o afiliación política. En el ámbito civil, el sesgo algorítmico produce decisiones injustas en créditos o contrataciones. En el ámbito militar, puede producir patrones sistemáticos de daño a poblaciones específicas. Este riesgo ha sido documentado por investigadores de la Universidad de Carnegie Mellon en el contexto de sistemas de vigilancia militar automatizada, y representa uno de los argumentos más sólidos para una moratoria internacional en el despliegue de estos sistemas sin marcos de auditoría independiente.

El Debate Estratégico: ¿Por qué el Pentágono está Avanzando de Todas Formas?

A pesar de todos los riesgos descritos, el impulso hacia la adopción de IA en decisiones militares tiene una lógica estratégica que no puede ignorarse. La velocidad de procesamiento de información en conflictos modernos supera con creces la capacidad cognitiva humana. Un analista humano puede revisar decenas de objetivos por hora; un sistema de IA puede procesar miles en segundos, incorporando variables de inteligencia en tiempo real, imágenes satelitales y comunicaciones interceptadas simultáneamente.

El argumento del Pentágono es que no usar IA equivale a una desventaja estratégica frente a potencias como China y Rusia, que ya están invirtiendo masivamente en sistemas equivalentes. Este es el mismo dilema del dilema del prisionero que enfrentan las corporaciones con la automatización: si tus competidores automatizan y tú no, pierdes. La diferencia es que en el contexto militar, las consecuencias de “perder” son medidas en vidas humanas, no en puntos de participación de mercado.

Este debate tiene paralelismos directos con la conversación que estamos teniendo en el sector empresarial sobre la economía de los sistemas multiagente y su retorno de inversión. La pregunta no es si la IA tomará decisiones, sino bajo qué marcos de gobernanza lo hará.

Qué están haciendo China y Rusia en este espacio

Los informes de inteligencia abierta de 2025 y 2026 indican que tanto China como Rusia han integrado sistemas de análisis predictivo asistido por modelos de lenguaje en sus cadenas de mando operacional. China, en particular, ha publicado documentos doctrinales que describen la “inteligentización” del campo de batalla como una prioridad estratégica nacional. Esto incluye sistemas de apoyo a la decisión que procesan datos de múltiples fuentes para generar recomendaciones tácticas en tiempo real. El Pentágono está respondiendo a esta realidad geopolítica, no simplemente experimentando con tecnología por curiosidad académica. Para los CIOs y CTOs que asesoran a gobiernos latinoamericanos, este contexto es esencial para comprender las próximas licitaciones y alianzas tecnológicas en el sector de seguridad nacional.

La posición de la comunidad internacional y los llamados a la regulación

El Comité Internacional de la Cruz Roja ha reiterado en múltiples declaraciones de 2025 y 2026 que los sistemas de armas autónomas —incluyendo aquellos que simplemente recomiendan objetivos— deben estar sujetos a marcos jurídicos internacionales obligatorios. Más de 30 países han firmado declaraciones de principios sobre el uso responsable de la IA en defensa, aunque ninguno de estos documentos tiene carácter vinculante. La Unión Europea, que ya promulgó la Ley de IA en 2024, clasifica los sistemas de decisión en contextos de aplicación de fuerza como de riesgo inaceptable en el ámbito civil, pero explícitamente excluye aplicaciones militares de su jurisdicción. Esta laguna regulatoria es, en 2026, uno de los vacíos normativos más peligrosos del ecosistema tecnológico global. Temas de gobernanza de IA similares los abordamos también en nuestro análisis sobre infraestructura de datos para agentes de IA en contextos empresariales.

Implicaciones para Líderes Tecnológicos y Empresariales en Latinoamérica

Para un CEO o CTO en México o Latinoamérica, este desarrollo puede parecer distante. No lo es. Las tecnologías que el Pentágono evalúa hoy para clasificación de objetivos son versiones especializadas de los mismos modelos de lenguaje que sus equipos de tecnología están evaluando para automatización de procesos, análisis de riesgo crediticio o gestión de cadenas de suministro. La diferencia no es técnica: es de dominio y consecuencias.

Lo que esta revelación enseña a cualquier líder tecnológico es que los modelos de lenguaje ya están siendo considerados para las decisiones más críticas que existen. Esto tiene tres implicaciones directas para el sector privado: primero, la presión regulatoria sobre el uso de IA en decisiones de alto impacto se intensificará en los próximos 18 meses; segundo, la demanda de arquitecturas de IA auditables y trazables crecerá exponencialmente; y tercero, las organizaciones que desarrollen marcos robustos de gobernanza de IA ahora tendrán una ventaja competitiva significativa cuando lleguen las regulaciones obligatorias.

**Para 2027, analistas de Gartner proyectan que más del 60% de las grandes corporaciones globales enfrentarán auditorías externas obligatorias de sus sistemas de IA en producción**, una tendencia directamente impulsada por casos como el que hoy reportamos desde el Departamento de Defensa. En nuestro análisis sobre jerarquías de instrucciones en modelos de lenguaje, ya avanzamos sobre cómo estructurar sistemas de IA con controles operacionales robustos. Ese conocimiento hoy es una ventaja competitiva; mañana será un requisito legal.

Cómo preparar tu organización ante la regulación inminente de la IA

El primer paso es mapear todos los sistemas de IA en producción que influyen en decisiones con impacto humano significativo: aprobación de créditos, selección de candidatos, diagnóstico médico, precios dinámicos. El segundo paso es implementar registros de auditoría que documenten el razonamiento del sistema en cada decisión relevante. El tercer paso es establecer protocolos formales de supervisión humana que vayan más allá de la firma de un documento: implican capacitación activa para resistir el sesgo de automatización. En iamanos.com diseñamos estas arquitecturas de gobernanza para empresas de todos los sectores. Si el Pentágono está teniendo esta conversación públicamente, el reloj regulatorio para el sector privado ya está corriendo.

Puntos Clave

El testimonio del funcionario del Departamento de Defensa de los Estados Unidos no es solo una noticia de geopolítica o tecnología militar. Es un espejo que muestra hacia dónde se dirige el uso de la inteligencia artificial en la toma de decisiones de máxima criticidad. En 2026, los mismos modelos de lenguaje que redactan correos, generan código y responden preguntas de clientes están siendo evaluados para recomendar objetivos en zonas de conflicto. Esto no es alarmismo: es la realidad que MIT Technology Review documentó y que nosotros analizamos con la profundidad que su impacto exige. Para los líderes tecnológicos y empresariales, la lección es inmediata: la gobernanza de la IA no es un tema de ética abstracta ni de relaciones públicas. Es una necesidad técnica, legal y estratégica. Las organizaciones que construyan hoy marcos sólidos de supervisión, trazabilidad y auditoría de sus sistemas de IA estarán mejor posicionadas ante la inevitable ola regulatoria y ante la demanda creciente de clientes y socios que exigirán transparencia algorítmica. En iamanos.com llevamos años construyendo exactamente eso. Conversemos.

Lo que necesitas saber

El funcionario reveló que el ejército de los Estados Unidos está evaluando el uso de sistemas de inteligencia artificial generativa para clasificar listas de objetivos militares y emitir recomendaciones sobre cuáles atacar primero, todo ello bajo supervisión humana formal.

Los tres riesgos principales son: la alucinación del modelo (generación de información incorrecta presentada como plausible), la opacidad interpretativa que impide auditar el razonamiento, y la vulnerabilidad a ataques de inyección de instrucciones por parte de actores adversarios.

El sesgo de automatización es la tendencia humana a aceptar recomendaciones de sistemas automatizados sin análisis crítico. Estudios indican que los operadores aprueban recomendaciones de IA hasta en un 87% de los casos sin modificaciones, lo que cuestiona la efectividad real de la supervisión humana.

El debate acelera la presión regulatoria sobre el uso de IA en decisiones de alto impacto en todos los sectores. Las empresas que adopten marcos de gobernanza, auditoría y trazabilidad de IA ahora tendrán ventaja competitiva cuando lleguen las regulaciones obligatorias, proyectadas para intensificarse antes de 2027.

Actualmente no existe un tratado internacional vinculante que regule el uso de sistemas de decisión basados en IA en contextos militares. La Ley de Inteligencia Artificial de la Unión Europea excluye explícitamente las aplicaciones militares de su jurisdicción, dejando un vacío normativo que múltiples organismos internacionales han señalado como urgente.

Un sistema de apoyo a la decisión emite recomendaciones que un humano debe aprobar antes de ejecutar una acción. Un sistema autónomo de armas actúa sin intervención humana. El debate actual gira precisamente en torno a si los sistemas de apoyo con alta confianza estadística funcionan en la práctica como sistemas autónomos debido al sesgo de automatización de los operadores.

Convierte este conocimiento en resultados

Nuestro equipo implementa soluciones de IA para empresas B2B. Agenda una consultoría gratuita.