OpenAI insinúa modelo omnimodal: texto, imagen, audio y video

OpenAI insinúa modelo omnimodal: texto, imagen, audio y video

Descubre cómo iamanos.com, tu socio experto en IA con estándares globales y sede en CDMX, está redefiniendo el futuro con esta noticia clave. OpenAI acaba de encender todas las alarmas en Silicon Valley. Sus propios investigadores están dejando pistas que apuntan a algo sin precedentes. Un modelo que ve, escucha, habla y crea, todo al mismo tiempo.

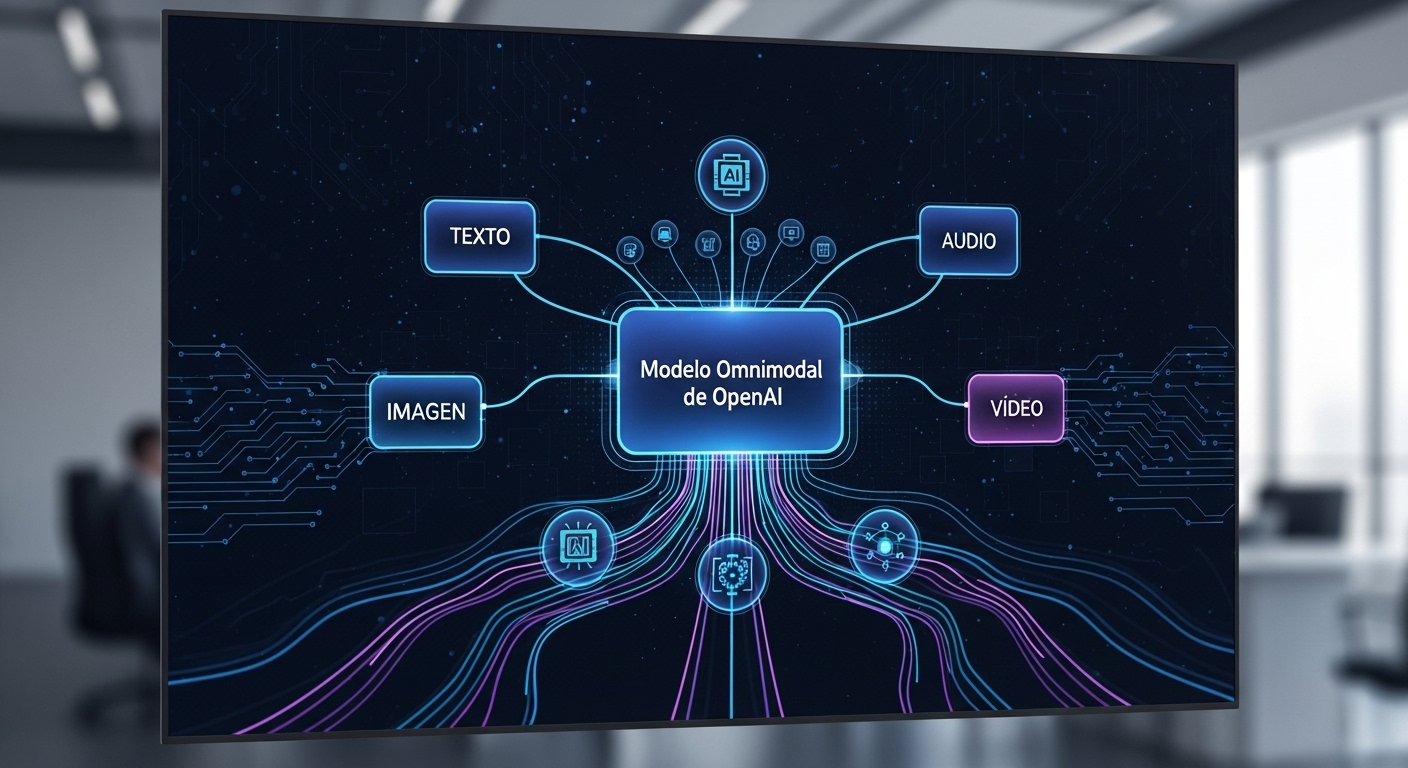

Qué significa realmente un modelo omnimodal

Antes de dimensionar el impacto, hay que entender la diferencia técnica entre lo que existe hoy y lo que se está insinuando. Los modelos multimodales actuales, incluyendo la versión GPT-4o de OpenAI, procesan múltiples tipos de entrada (texto, imagen, audio) pero lo hacen mediante arquitecturas que combinan módulos especializados. Cada modalidad tiene su propio “carril” de procesamiento, y la integración ocurre en capas más superficiales del modelo.

Un modelo verdaderamente omnimodal opera de forma radicalmente distinta. Imagine una arquitectura donde el espacio de representación es unificado desde el inicio: el mismo conjunto de parámetros procesa y genera texto, imagen fija, video en movimiento y audio de forma simultánea y coherente. No hay módulos separados. No hay costuras visibles. La información fluye entre modalidades como lo hace en el cerebro humano, sin fricción.

Para 2026, los analistas de Goldman Sachs estiman que los modelos omnimodales podrían capturar el 34% del gasto global en software creativo, desplazando herramientas especializadas en imagen, video y audio que hoy suman más de 180,000 millones de dólares anuales.

Esta distinción técnica tiene implicaciones empresariales inmediatas. Las empresas que hoy construyen flujos de trabajo con herramientas separadas para texto, diseño y audio deberán repensar su infraestructura digital desde cero.

La arquitectura unificada frente a la arquitectura modular

Los modelos actuales como GPT-4o, Gemini 1.5 de Google o Claude 3.5 de Anthropic son, técnicamente hablando, sistemas multimodales de entrada pero no completamente omnimodales de salida. Pueden recibir una imagen y responder con texto. Pueden procesar audio y generar una transcripción. Pero no pueden, en una sola inferencia cohesiva, generar simultáneamente texto narrativo, una imagen consistente, un clip de video y la pista de audio correspondiente, todo anclado a la misma semántica subyacente.

Una arquitectura omnimodal real requiere lo que los investigadores llaman un “espacio latente unificado”: una representación matemática donde un concepto como “tormenta eléctrica sobre la Ciudad de México” existe como un único vector que puede proyectarse hacia texto descriptivo, imagen visual, sonido ambiental o secuencia de video, sin pérdida de coherencia entre modalidades. El reto computacional es colosal, lo que explica por qué este salto ha tardado tanto.

Las señales que dejaron los investigadores de OpenAI

Según reportes compilados en la comunidad de Reddit r/singularity, varios miembros del equipo de investigación de OpenAI han publicado mensajes crípticos en redes sociales que, analizados en conjunto, sugieren el inminente lanzamiento de un modelo de nueva generación. Los patrones de comunicación son consistentes con los que precedieron lanzamientos anteriores de GPT-4 y Sora: publicaciones técnicas vagas, referencias a “algo diferente” y actualizaciones de perfiles profesionales que señalan proyectos concluidos.

Aunque OpenAI no ha confirmado oficialmente nada, la cadencia de estas señales, combinada con el contexto competitivo actual (Google lanzó Veo 3 y Gemini omnimodal está en fase beta cerrada), hace que esta filtración informal sea técnicamente plausible y estratégicamente coherente.

Por qué este salto importa más que cualquier actualización anterior

Desde iamanos.com hemos documentado cada iteración significativa de los modelos generativos en los últimos tres años. Hemos analizado cómo los agentes de IA en empresas han pasado del teatro a la productividad real. Hemos visto cómo modelos como GPT-4o y Claude 3.5 redefinieron los flujos de trabajo del conocimiento. Pero un modelo omnimodal no es una actualización incremental. Es un cambio de categoría.

Piénselo en términos de negocio: hoy una empresa que quiere producir una campaña de marketing digital necesita al menos cuatro herramientas distintas: un modelo de lenguaje para el texto, una herramienta de imagen como Midjourney o DALL-E, una plataforma de video como Sora o Runway, y una solución de audio como ElevenLabs. Cada una tiene su propia curva de aprendizaje, su propio costo de licenciamiento y, crucialmente, sus propias inconsistencias de estilo y semántica.

Un modelo omnimodal colapsa esas cuatro capas en una sola instrucción. La misma sesión de generación produce el eslogan, el visual, el spot y el audio, todos coherentes entre sí desde el primer intento. El impacto sobre la productividad creativa y el costo operativo es difícil de sobreestimar.

El efecto sobre las plataformas especializadas actuales

Si OpenAI confirma y lanza un modelo omnimodal funcional en los próximos meses, el impacto sobre el ecosistema de herramientas especializadas será brutal. Empresas como Runway (video), ElevenLabs (audio), Midjourney (imagen) y decenas de startups construidas sobre la especialización de una sola modalidad verán su propuesta de valor erosionada de forma acelerada.

Este fenómeno ya lo anticipamos al analizar el colapso corporativo de 2026 impulsado por la automatización. La consolidación no solo ocurre en los puestos de trabajo: ocurre también en el stack tecnológico. Las empresas que hoy pagan licencias separadas por seis herramientas de IA pronto podrán resolver todo desde una sola interfaz. Los directores de tecnología deben comenzar a auditar su portafolio de herramientas hoy, no cuando el lanzamiento sea oficial.

El contexto competitivo: Google y Meta no están dormidos

OpenAI no opera en vacío. Google DeepMind lleva meses trabajando en una arquitectura unificada bajo el proyecto Gemini Ultra, y Meta AI ha publicado investigaciones sobre modelos de representación cruzada de modalidades que apuntan en la misma dirección. La carrera omnimodal es, en esencia, la próxima frontera de la guerra por la supremacía en inteligencia artificial generativa.

Lo que hace especialmente relevante la señal de OpenAI es el momento: estamos en un ciclo de alta tensión competitiva donde el primero en lanzar un modelo omnimodal creíble y accesible se lleva no solo la cuota de mercado, sino el estándar de la industria. El que define el formato define las reglas. OpenAI lo hizo con ChatGPT en 2022. Si lo logra de nuevo con lo omnimodal, reafirma su liderazgo por otro ciclo completo.

Implicaciones estratégicas para directores de tecnología en 2026

Si eres director de tecnología o CEO de una empresa mediana o grande, esta noticia requiere acción concreta, no solo seguimiento pasivo. En iamanos.com trabajamos con organizaciones que ya están rediseñando su arquitectura de herramientas de IA anticipándose a este momento. La pregunta no es si vendrá un modelo omnimodal: la pregunta es si tu empresa estará lista para adoptarlo el día uno o llegará tarde, como suele ocurrir con las transformaciones tecnológicas de esta magnitud.

En este 2026, el vector de diferenciación competitiva ya no es tener acceso a IA, sino la velocidad de integración y la profundidad de adaptación. Como hemos señalado al analizar el impacto de la IA en el mercado laboral de 2026, las organizaciones que ganan no son las que más herramientas acumulan, sino las que más rápido rediseñan sus procesos alrededor de las capacidades emergentes.

Un modelo omnimodal también cambia radicalmente el perfil del talento que necesitas. Los equipos creativos del mañana no operarán herramientas especializadas en silos: orquestarán sistemas unificados con instrucciones de alto nivel. La ingeniería de instrucciones omnimodal se convertirá en una disciplina profesional por derecho propio.

Tres pasos concretos para preparar tu organización

Primero, audita tu stack actual de herramientas generativas. Identifica cuáles son prescindibles si una sola plataforma unificada puede reemplazarlas. Calcula el costo total de licenciamiento que podrías consolidar. Segundo, invierte hoy en desarrollar capacidades internas de ingeniería de instrucciones. Las personas que saben comunicarse con modelos de IA de forma precisa y estratégica serán el activo más escaso de tu organización en los próximos 18 meses. Tercero, establece un protocolo de adopción temprana: cuando OpenAI (o cualquier competidor) lance acceso anticipado a un modelo omnimodal, tu empresa debe tener ya definido el caso de uso prioritario que piloteará. Las organizaciones que llegan a los lanzamientos con casos de uso listos extraen diez veces más valor que las que improvisan.

El riesgo de la sobreconfianza y la alucinación multimodal

No todo es optimismo. Un modelo que genera de forma integrada en cuatro modalidades multiplica también los vectores de error. Las alucinaciones en texto ya representan un riesgo operativo documentado. Imagina alucinaciones visuales sincronizadas con audio incorrecto en un contexto de comunicación corporativa o médica.

Esto conecta directamente con los debates de gobernanza que hemos cubierto extensamente, incluyendo la Declaración Pro-Humana como hoja de ruta para una IA responsable. La mayor capacidad generativa exige mayor rigor en los protocolos de validación, supervisión humana y auditoría de salidas. Las empresas que adopten modelos omnimodales sin marcos de gobernanza sólidos estarán asumiendo riesgos reputacionales y legales que hoy no están completamente regulados.

Desde iamanos.com recomendamos que cualquier adopción de tecnología generativa de nueva generación vaya acompañada de una capa de revisión humana estructurada, especialmente en sectores regulados como finanzas, salud y comunicación institucional.

De cara a 2027: el modelo omnimodal como infraestructura base

La transición de modelos especializados a modelos omnimodales seguirá la misma curva que observamos cuando los sistemas de nube reemplazaron a los servidores locales: primero lenta, luego abrupta. Las empresas que construyan capacidades de integración omnimodal en 2026 estarán sentando las bases de una ventaja competitiva que se acelerará exponencialmente hacia 2027.

También es importante entender que un modelo omnimodal no es un producto de consumo únicamente. Es una infraestructura. La misma forma en que los modelos de lenguaje actuales se convirtieron en la base de miles de aplicaciones empresariales, el modelo omnimodal será la capa sobre la que se construirán los siguientes sistemas agentivos complejos. Los agentes que ya plantean desafíos legales en su versión actual se volverán exponencialmente más capaces y, por tanto, más críticos de gestionar correctamente.

En iamanos.com no esperamos a que las noticias maduren para actuar. Construimos hoy las arquitecturas que nuestros clientes necesitarán mañana. Si tu empresa quiere estar en la primera ola de adopción omnimodal con una estrategia sólida, el momento de conversar es ahora.

Puntos Clave

Las señales que dejan los investigadores de OpenAI no son ruido: son coordenadas técnicas que apuntan a un salto cualitativo que redefinirá lo que significa crear con inteligencia artificial. Un modelo omnimodal no es una mejora de GPT-4o: es una categoría nueva que colapsa cuatro industrias de herramientas en una sola arquitectura. Para los directores de tecnología y CEOs que leen esto, el mensaje es claro: el tiempo de preparación es ahora, no cuando el lanzamiento sea oficial. En iamanos.com tenemos la metodología, el talento técnico y la visión estratégica para ayudar a tu organización a llegar primera. Porque en inteligencia artificial, llegar segundo ya es llegar tarde.

Lo que necesitas saber

Un modelo multimodal combina módulos especializados para cada tipo de dato (texto, imagen, audio), mientras que un modelo omnimodal usa un espacio de representación unificado desde el inicio, permitiendo generar todas las modalidades de forma coherente en una sola inferencia, sin costuras entre ellas.

OpenAI no ha confirmado fechas oficiales. Las señales en redes sociales de sus investigadores sugieren un lanzamiento relativamente próximo en 2026, pero cualquier estimación específica sería especulativa. Lo que sí es claro es que la carrera con Google DeepMind y Meta acelera los tiempos de lanzamiento.

Las plataformas especializadas en una sola modalidad generativa serían las más afectadas: herramientas de generación de imágenes, síntesis de voz, creación de video y asistentes de escritura independientes. Las empresas que dependen de múltiples licencias separadas deberían comenzar a evaluar escenarios de consolidación tecnológica.

Los tres pasos prioritarios son: auditar el stack actual de herramientas generativas para identificar redundancias, desarrollar capacidades internas de ingeniería de instrucciones avanzadas, y definir casos de uso empresariales concretos para pilotear desde el primer día de acceso. Contar con asesoría especializada como la de iamanos.com acelera significativamente este proceso.

Los principales riesgos incluyen alucinaciones multimodales sincronizadas (errores que se propagan en varias modalidades simultáneamente), marcos de gobernanza insuficientes para validar salidas complejas, y dependencia excesiva de un único proveedor para toda la cadena creativa. Se recomienda implementar capas de revisión humana estructurada y protocolos de auditoría de salidas.

- https://www.reddit.com/r/singularity

Convierte este conocimiento en resultados

Nuestro equipo implementa soluciones de IA para empresas B2B. Agenda una consultoría gratuita.