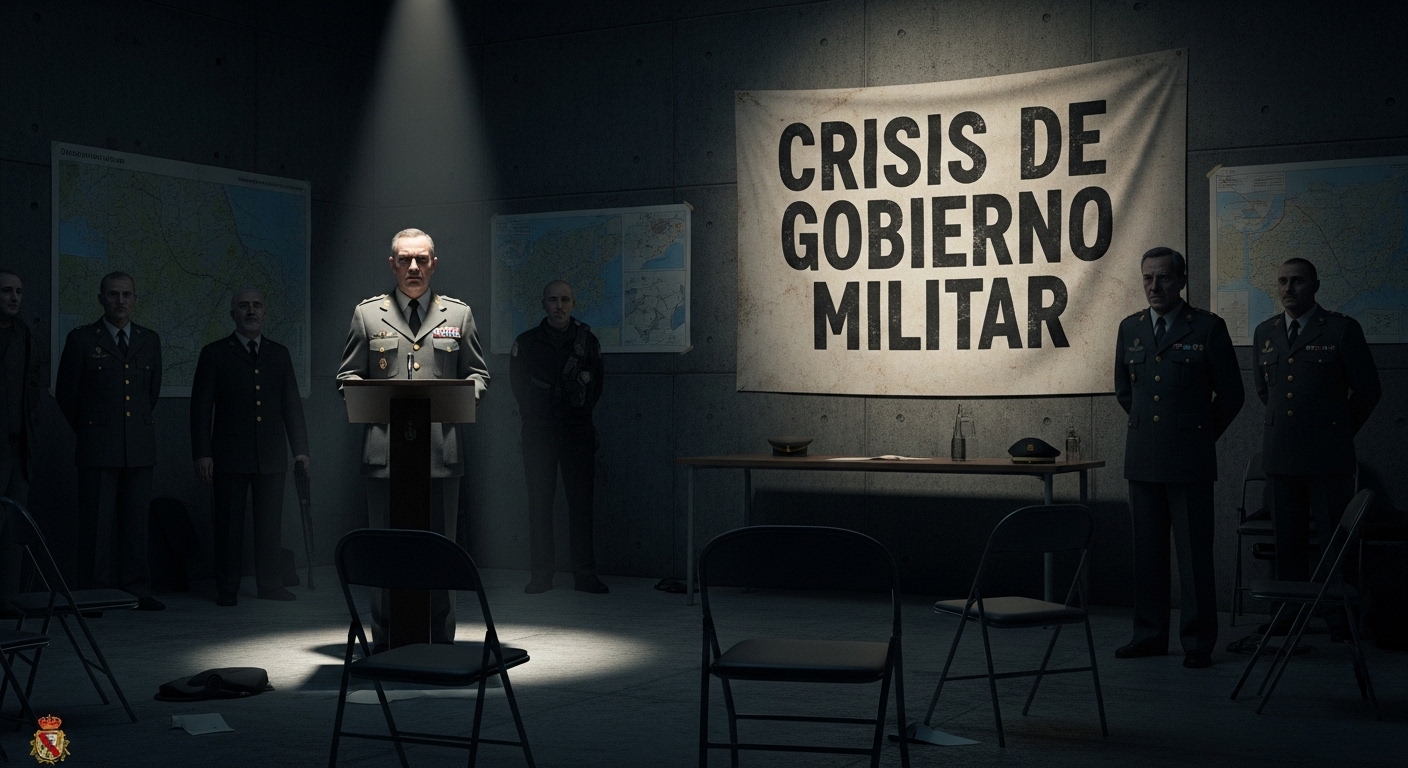

OpenAI pierde a Kalinowski: Crisis de Gobernanza Militar

OpenAI pierde a Kalinowski: Crisis de Gobernanza Militar

iamanos.com: Expertos en Inteligencia Artificial de alto calibre. Traemos la tecnología más avanzada del mundo a tu alcance, explicada con claridad estratégica. En este 2026, las decisiones de gobernanza no son filosóficas: son ventajas competitivas o catas de reputación que destruyen marcas en días. La renuncia de Caitlin Kalinowski a OpenAI no es solo una salida ejecutiva. Es una señal de alarma que todo CEO y Director de Tecnología debe leer con urgencia.

La Renuncia que Ningún Comunicado Puede Ocultar

El 7 de marzo de 2026, Caitlin Kalinowski —líder del equipo de robótica de acuerdo-pentagono-gobernanza-ia-2026/” target=”_blank” rel=”noopener noreferrer”>OpenAI y ex directora del proyecto de lentes de realidad aumentada en Meta— anunció públicamente su salida de la compañía. Su motivo: el acuerdo firmado entre OpenAI y el Departamento de Defensa de los Estados Unidos. Kalinowski no fue discreta. Utilizó sus redes sociales para documentar, con precisión quirúrgica, exactamente qué líneas considera que fueron cruzadas sin suficiente deliberación institucional.

Según TechCrunch, la ejecutiva declaró: “La vigilancia de ciudadanos estadounidenses sin supervisión judicial y la autonomía letal sin autorización humana son líneas que merecían más deliberación de la que recibieron.” Esta no es la denuncia de una empleada descontenta. Es el diagnóstico de una arquitecta técnica de alto nivel que sabe exactamente qué significa implementar sistemas en entornos clasificados.

Una Carrera que Habla por Sí Misma

Kalinowski se incorporó a acuerdo-pentagono-gobernanza-ia-2026/” target=”_blank” rel=”noopener noreferrer”>OpenAI en noviembre de 2024 para dirigir la división de robótica, un área estratégica que la compañía había identificado como prioritaria de cara al despliegue de sistemas físicos autónomos. Antes de OpenAI, había liderado en Meta el desarrollo de lentes de realidad aumentada, un proyecto que combina percepción espacial, procesamiento en tiempo real y hardware de precisión. Su perfil es exactamente el tipo de talento que cualquier organización de defensa querría tener en la sala cuando se diseñan protocolos de autonomía. Que ella sea quien se vaya —y que lo haga de manera pública— amplifica exponencialmente el peso del mensaje.

El Principio Sobre las Personas

Un dato que los analistas no deben pasar por alto: Kalinowski fue explícita en señalar que su decisión fue “acuerdo-pentagono-gobernanza-ia-2026/” target=”_blank” rel=”noopener noreferrer”>sobre principios, no sobre personas”, y expresó “profundo respeto” por el director ejecutivo Sam Altman y el equipo de OpenAI. Esto elimina la narrativa de conflicto personal y deja en pie únicamente la crítica institucional. En un segundo comunicado publicado en la red social X, añadió: “Mi problema es que el anuncio fue apresurado sin que los guardarraíles estuvieran definidos. Es una preocupación de gobernanza, ante todo. Estos temas son demasiado importantes para acuerdos o anuncios que se precipiten.” Para cualquier organización que gestione proyectos de inteligencia artificial en 2026, esta frase debe convertirse en un principio rector.

Anatomía del Acuerdo que Desató la Crisis

Para entender la magnitud de lo que está ocurriendo, es necesario reconstruir la secuencia de eventos. El Departamento de Defensa de los Estados Unidos inició negociaciones con Anthropic para obtener acceso a sus modelos de lenguaje con aplicaciones en entornos de seguridad nacional. Anthropic intentó negociar salvaguardas específicas que impidieran el uso de su tecnología en vigilancia masiva doméstica o en sistemas de armas completamente autónomas. Las negociaciones fracasaron. Como represalia, el Pentágono designó a Anthropic como “riesgo en la cadena de suministro”, una clasificación con consecuencias contractuales severas.

OpenAI tomó un camino diferente. En lugar de exigir las mismas salvaguardas, firmó un acuerdo que permite el uso de sus modelos en entornos clasificados, describiendo su enfoque como “más expansivo y multicapa”, basado no solo en lenguaje contractual sino en salvaguardas técnicas. Aquí está el problema fundamental: esas salvaguardas técnicas no fueron detalladas públicamente antes del anuncio. Y esa opacidad es precisamente lo que Kalinowski identifica como la falla crítica de gobernanza. Como hemos documentado en nuestro análisis sobre la gobernanza que nadie midió, la velocidad del anuncio superó la madurez del marco ético que lo debía sostener.

Los Dos Límites No Negociables en la Inteligencia Artificial Militar

El debate no es binario entre “usar IA en defensa” o “no usarla”. Es mucho más granular. Existen dos líneas rojas que los expertos en gobernanza de inteligencia artificial identifican como absolutas. La primera: vigilancia de ciudadanos sin supervisión judicial. La segunda: sistemas letales con autonomía total, sin autorización humana en el ciclo de decisión. acuerdo-pentagono-gobernanza-ia-2026/” target=”_blank” rel=”noopener noreferrer”>OpenAI afirma que su acuerdo mantiene estas líneas como intocables. Kalinowski cuestiona no si el acuerdo lo dice, sino si el proceso que lo produjo fue lo suficientemente riguroso para garantizarlo. Esa diferencia —entre declarar una salvaguarda y haberla arquitecturado técnicamente— es exactamente donde los sistemas de inteligencia artificial fallan en implementaciones a escala.

Lo que Dijo OpenAI en su Respuesta Oficial

El portavoz de OpenAI confirmó la salida de Kalinowski a TechCrunch y emitió la siguiente declaración: “Creemos que nuestro acuerdo con el Pentágono crea un camino viable para usos responsables de la inteligencia artificial en seguridad nacional, dejando claras nuestras líneas rojas: sin vigilancia doméstica y sin armas autónomas. Reconocemos que las personas tienen opiniones sólidas sobre estos temas y continuaremos el diálogo con empleados, gobierno, sociedad civil y comunidades de todo el mundo.” La declaración es correcta en forma, pero incompleta en sustancia. No aborda el argumento central de Kalinowski: que el anuncio fue apresurado. Y en gobernanza de inteligencia artificial, el proceso importa tanto como el resultado.

El Impacto en el Mercado: Números que Obligan a Actuar

La crisis de gobernanza no se queda en los pasillos ejecutivos. Tiene consecuencias medibles en el mercado. **Para 2026, se proyecta que el 40% de las empresas tecnológicas que operan en sectores regulados enfrentarán escrutinio público equivalente por sus acuerdos de defensa**, lo que convierte la gobernanza de inteligencia artificial en una variable de valoración de mercado, no solo de cumplimiento normativo.

Los datos actuales son contundentes: según información reportada por TechCrunch, las desinstalaciones de la aplicación de ChatGPT se dispararon un 295% tras el anuncio del acuerdo con el Pentágono. Al mismo tiempo, Claude —el modelo de Anthropic— escaló a la posición número uno en las listas de aplicaciones gratuitas de la tienda de aplicaciones de los Estados Unidos, con ChatGPT en segundo lugar. Puedes profundizar en este desplazamiento en nuestro análisis sobre el ascenso de Claude frente a las desinstalaciones de ChatGPT.

Esto demuestra algo que muchos directores de tecnología subestiman: los usuarios de inteligencia artificial generativa —incluyendo consumidores y empresas— están comenzando a tomar decisiones de adopción basadas en criterios éticos y de gobernanza, no solo en capacidad técnica.

Anthropic: El Ecosistema que Resistió y Sus Aliados Estratégicos

El caso de Anthropic merece atención particular. Después de ser clasificada como “riesgo en la cadena de suministro” por el Pentágono —una designación que la compañía está impugnando legalmente—, tres de los gigantes tecnológicos más importantes confirmaron que continuarán distribuyendo el modelo Claude a clientes no relacionados con defensa: Microsoft, Google y Amazon. Esto no es un gesto simbólico. Es una declaración estratégica de que la gobernanza ética tiene respaldo de infraestructura en 2026. Para los líderes empresariales que evalúan qué proveedor de inteligencia artificial integrar en sus operaciones, este alineamiento de las plataformas de computación en la nube con los estándares éticos de Anthropic es una señal de mercado significativa. Puedes leer más sobre esta dinámica en nuestro análisis de Anthropic frente al Pentágono.

La Paradoja del Talento: Cuando Perder a un Líder es una Advertencia Sistémica

La industria de la inteligencia artificial enfrenta en 2026 una paradoja crítica: las organizaciones que más necesitan talento técnico de alto nivel son las que más riesgo corren de perderlo si no construyen marcos de gobernanza robustos antes de firmar acuerdos de alto perfil. Kalinowski no es un caso aislado. Es el síntoma de una tensión estructural entre la velocidad comercial que exigen los mercados y la madurez institucional que exige la ética técnica. Las empresas que no resuelvan esta tensión en 2026 lo pagarán en fuga de talento, erosión de confianza y pérdida de cuota de mercado. Como hemos documentado en nuestro análisis sobre la brecha operativa entre pilotos de IA y producción real, la velocidad sin arquitectura de gobernanza es una deuda técnica que eventualmente vence.

Qué Deben Aprender los Líderes Empresariales de Este Momento

La renuncia de Kalinowski no es solo una historia sobre OpenAI y el Pentágono. Es un caso de estudio sobre cómo la gobernanza de la inteligencia artificial se convierte en un factor de riesgo empresarial de primer nivel. Cualquier organización que esté desplegando, comprando o integrando sistemas de inteligencia artificial en 2026 debe extraer lecciones operativas concretas de este episodio.

Primero: la velocidad de los acuerdos comerciales no puede superar la velocidad de definición de salvaguardas técnicas. Segundo: la comunicación interna sobre decisiones de alto impacto debe preceder —no seguir— al anuncio público. Tercero: los ejecutivos técnicos de alto nivel deben ser parte activa del proceso de gobernanza antes de que los contratos se firmen. Cuarto: la reputación en inteligencia artificial es un activo volátil que puede colapsar en días, como demuestran los datos de desinstalaciones de ChatGPT.

En iamanos.com, trabajamos con empresas en México y América Latina para construir exactamente este tipo de marcos de gobernanza antes de que sean necesarios en una crisis. La consultoría estratégica en inteligencia artificial no es un lujo: es la diferencia entre liderar y reaccionar. También es relevante considerar cómo los sistemas de agentes de inteligencia artificial están ampliando el perímetro de riesgo ético que las organizaciones deben gestionar.

Los Tres Guardarraíles que Todo Acuerdo de Inteligencia Artificial Debe Tener

Basándonos en el análisis del caso OpenAI-Pentágono y en los estándares emergentes de gobernanza técnica para 2026, cualquier organización que firme acuerdos de uso de inteligencia artificial en sectores sensibles debe garantizar tres elementos mínimos. Primero, definición técnica documentada de los límites de uso antes del anuncio público. Segundo, mecanismos de auditoría independiente con acceso a los sistemas en producción. Tercero, protocolos de supervisión humana explícitos en cada etapa del ciclo de decisión donde el sistema pueda tener consecuencias para personas. Estos no son requisitos regulatorios opcionales. Son condiciones mínimas de confianza técnica en 2026.

El Nuevo Estándar de Gobernanza que Está Emergiendo del Caos

Lo que está emergiendo de este episodio no es solo una crisis para OpenAI. Es la cristalización de un nuevo estándar de gobernanza para la industria de la inteligencia artificial. Las organizaciones que adopten este estándar de manera proactiva —antes de que una crisis los obligue— serán las que retengan talento de élite, capturen la confianza de usuarios empresariales y construyan ventajas competitivas sostenibles. Las que lo ignoren se encontrarán en el lugar de OpenAI en este momento: defendiendo decisiones apresuradas frente a una opinión pública que ya tiene alternativas con un solo clic en su dispositivo.

Puntos Clave

La renuncia de Caitlin Kalinowski a OpenAI es, en esencia, un referendum sobre cómo la industria de la inteligencia artificial gestiona el poder que ha acumulado. No se trata de estar a favor o en contra del uso de inteligencia artificial en defensa nacional. Se trata de si las organizaciones tienen la madurez institucional para manejar esa responsabilidad con la deliberación que merece. En iamanos.com somos la agencia número uno en México con estándares técnicos de Silicon Valley, y entendemos que la gobernanza de la inteligencia artificial no es un tema de cumplimiento normativo: es una estrategia de negocio. Las empresas que construyan marcos de gobernanza sólidos antes de necesitarlos serán las que lideren el mercado de cara a 2027. Las que esperen a que una crisis las obligue pagarán el precio en reputación, talento y cuota de mercado. La pregunta para cada CEO y Director de Tecnología que lee este análisis es simple: ¿tu organización tiene sus guardarraíles definidos antes del próximo acuerdo importante, o los está improvisando sobre la marcha?

Lo que necesitas saber

Kalinowski renunció en respuesta al acuerdo firmado entre OpenAI y el Departamento de Defensa de los Estados Unidos. Su objeción principal no fue el uso de inteligencia artificial en seguridad nacional per se, sino que el anuncio fue apresurado sin que los guardarraíles técnicos y de gobernanza estuvieran definidos previamente. Señaló específicamente la vigilancia de ciudadanos sin supervisión judicial y la autonomía letal sin autorización humana como las líneas críticas que no recibieron suficiente deliberación.

El impacto fue inmediato y medible. Las desinstalaciones de la aplicación de ChatGPT aumentaron un 295% tras el anuncio del acuerdo. Simultáneamente, Claude de Anthropic escaló a la posición número uno en la tienda de aplicaciones de Estados Unidos, desplazando a ChatGPT al segundo lugar. Esto indica que los usuarios están incorporando criterios de gobernanza ética en sus decisiones de adopción de herramientas de inteligencia artificial.

Anthropic intentó negociar salvaguardas contractuales explícitas que impidieran el uso de sus modelos en vigilancia masiva doméstica o sistemas de armas completamente autónomas. Al no lograrlo, rechazó el acuerdo y fue clasificada como riesgo en la cadena de suministro. OpenAI optó por firmar un acuerdo que permite acceso en entornos clasificados, argumentando que usa un enfoque multicapa con salvaguardas técnicas además de contractuales, aunque sin detallarlas públicamente antes del anuncio.

Las organizaciones deben definir sus límites técnicos de uso antes de firmar acuerdos de alto impacto, incluir a ejecutivos técnicos de nivel senior en el proceso de gobernanza previo al anuncio, establecer mecanismos de auditoría independiente y mantener protocolos explícitos de supervisión humana en decisiones críticas. La gobernanza de inteligencia artificial debe ser una estrategia proactiva, no una respuesta reactiva a crisis públicas.

Anthropic ha anunciado que impugnará la designación legalmente. En paralelo, Microsoft, Google y Amazon confirmaron que continuarán distribuyendo el modelo Claude a clientes no relacionados con defensa, lo que garantiza la continuidad de acceso para el mercado empresarial y de consumo. Esto demuestra que el ecosistema de computación en la nube está respaldando los estándares de gobernanza de Anthropic con infraestructura real.

Convierte este conocimiento en resultados

Nuestro equipo implementa soluciones de IA para empresas B2B. Agenda una consultoría gratuita.