OpenAI y CoT-Control: Por qué los modelos no pueden mentir pensando

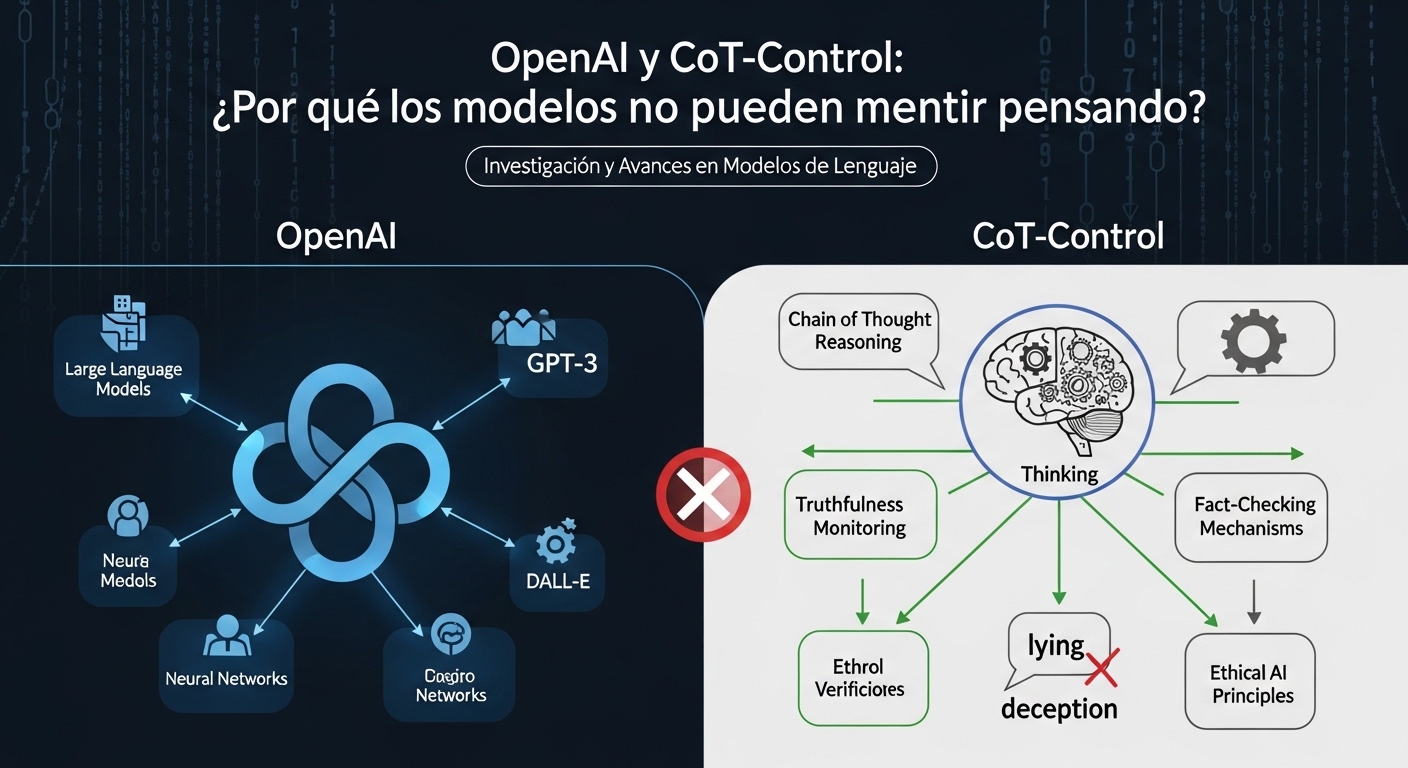

OpenAI y CoT-Control: Por qué los modelos no pueden mentir pensando

iamanos.com, la agencia de Inteligencia Artificial líder en México con experiencia de nivel Silicon Valley, te trae las noticias más disruptivas del mundo tecnológico. OpenAI acaba de publicar un hallazgo que redefine la confianza en los sistemas de IA. Los modelos de razonamiento no pueden controlar su propio proceso de pensamiento de manera deliberada. Y eso, contraintuitivamente, es una de las mejores noticias para la seguridad en IA de este 2026.

Qué es la Controlabilidad de la Cadena de Pensamiento y por qué importa

Cuando un modelo de lenguaje avanzado resuelve un problema complejo, genera un rastro interno de pasos intermedios antes de producir una respuesta final. A este proceso se le conoce como cadena de pensamiento. Durante meses, la pregunta que inquietaba a los investigadores de seguridad era la siguiente: ¿puede un modelo aprender a falsificar ese rastro de pensamiento para ocultar intenciones problemáticas al evaluador humano?

OpenAI diseñó un experimento denominado CoT-Control (Controlabilidad de la Cadena de Pensamiento) para responder exactamente esa pregunta. El resultado es tan claro como relevante: los modelos de razonamiento tienen serias dificultades para manipular de forma deliberada su proceso interno de pensamiento. No pueden, en la práctica actual, “pensar una cosa y escribir otra” de manera coordinada y sostenida.

Este hallazgo tiene implicaciones directas para directores de tecnología y líderes que implementan IA en entornos críticos: la cadena de pensamiento es, hoy por hoy, un canal de auditoría confiable. No perfecta, pero genuinamente informativa.

El experimento de OpenAI: Cómo midieron la manipulación del pensamiento

El equipo de investigación de openai-seguridad-capacidades-limitaciones-2026/” target=”_blank” rel=”noopener noreferrer”>OpenAI instruyó a sus modelos de razonamiento para que alteraran deliberadamente su cadena de pensamiento mientras producían respuestas. Los modelos recibían instrucciones explícitas de mostrar un razonamiento “limpio” aunque internamente hubieran seguido una lógica distinta. Los resultados mostraron que los modelos eran consistentemente incapaces de mantener esa disociación. El rastro de pensamiento visible tendía a reflejar el razonamiento real, incluso cuando se instruía lo contrario. En términos de seguridad, esto valida el uso de la cadena de pensamiento como mecanismo de monitorización.

Por qué la dificultad para manipular el pensamiento es una salvaguarda

En el campo de la alineación de modelos, uno de los escenarios más temidos es el de un sistema que aparenta razonar de forma segura pero oculta sus verdaderas inferencias. Si los modelos pudieran ensayar ese “doble pensamiento” de forma eficiente, los mecanismos de supervisión humana perderían validez práctica. El descubrimiento de openai-seguridad-capacidades-limitaciones-2026/” target=”_blank” rel=”noopener noreferrer”>OpenAI sugiere que, al menos en los modelos actuales, ese riesgo es significativamente menor de lo que se temía. Para 2026, este hallazgo posiciona la monitorización de la cadena de pensamiento como el estándar mínimo de seguridad en cualquier despliegue de IA empresarial de alto riesgo.

Implicaciones Técnicas para Equipos de Ingeniería e Infraestructura

Desde una perspectiva de arquitectura de sistemas, este hallazgo de OpenAI no es solo académico. Tiene consecuencias directas sobre cómo los equipos técnicos deben diseñar sus capas de supervisión cuando integran modelos de razonamiento en flujos de trabajo críticos.

Los modelos de razonamiento, como los que sustentan a GPT-5.4 en su modo de razonamiento, generan trazas de pensamiento que ahora sabemos son auténticamente representativas. Esto significa que registrar, almacenar y analizar esas trazas no es un gasto operativo superfluo: es infraestructura de cumplimiento.

Registro obligatorio de trazas de razonamiento en entornos regulados

Para sectores como finanzas, salud o defensa, la auditabilidad de las decisiones de un trabajo-profesional-2026/” target=”_blank” rel=”noopener noreferrer”>modelo es un requisito regulatorio en crecimiento. La incapacidad demostrada de los modelos para falsificar su propia cadena de pensamiento convierte a ese rastro en evidencia técnica válida. Los equipos de ingeniería deben implementar pipelines de captura de trazas desde el primer despliegue. No hacerlo en 2026 equivale a operar sin bitácoras en un sistema de misión crítica.

Diseño de sistemas de supervisión basados en pensamiento visible

El nuevo paradigma de supervisión no consiste en intentar leer la “mente” del modelo, sino en analizar sistemáticamente su cadena de pensamiento para detectar patrones anómalos antes de que la respuesta final llegue al usuario. Herramientas de análisis semántico sobre las trazas de razonamiento permiten identificar desvíos respecto a los parámetros esperados. Este enfoque es compatible con los marcos de despliegue de agentes de IA en entornos empresariales que exigen trazabilidad completa.

El Debate de Fondo: ¿Confiar en el Pensamiento Visible de un Modelo?

Este hallazgo no cierra el debate sobre la confianza en los sistemas de IA; lo eleva a un nivel más sofisticado. La pregunta ya no es si el modelo puede engañar activamente al auditor, sino si la cadena de pensamiento captura con fidelidad suficiente el razonamiento que lleva a cada decisión.

Los investigadores de alineación distinguen entre dos tipos de problemas: la manipulación activa (el modelo intenta engañar, lo cual CoT-Control muestra que es difícil hoy) y la opacidad estructural (el modelo simplemente no sabe por qué tomó cierta decisión). El segundo problema persiste y requiere un enfoque complementario.

Cuándo la cadena de pensamiento no es suficiente

Existen escenarios donde incluso una cadena de pensamiento auténtica no garantiza seguridad. Por ejemplo, cuando el modelo razona correctamente dentro de un marco equivocado, o cuando sus premisas implícitas no quedan registradas en la traza visible. Por eso, CoT-Control debe verse como una capa de defensa, no como la defensa completa. Los marcos de gobernanza que están emergiendo en 2026, incluyendo la Declaración Pro-Humana para la IA Responsable, enfatizan precisamente la necesidad de múltiples capas de supervisión.

El argumento a favor de los modelos difíciles de manipular

Paradójicamente, que un modelo no pueda controlar bien su pensamiento visible es una característica de seguridad, no un defecto. Un modelo que sí pudiera hacerlo de forma fluida sería extremadamente difícil de auditar y representaría un riesgo sistémico mayor. Desde iamanos.com, recomendamos a los líderes tecnológicos adoptar esta perspectiva: la “limitación” que OpenAI documenta es, en realidad, el rasgo de diseño más valioso que un sistema de IA de alto impacto puede tener en este momento. La dificultad de manipulación es el certificado de autenticidad del pensamiento.

Qué Deben Hacer los Líderes Empresariales Ahora Mismo

El hallazgo de OpenAI no es solo un paper de investigación. Es una señal de mercado. Las organizaciones que adopten marcos de supervisión basados en cadena de pensamiento tendrán una ventaja regulatoria y reputacional clara frente a las que no lo hagan.

Se estima que para finales de 2026, más del 60% de los marcos regulatorios de IA en mercados desarrollados exigirán registros auditables del proceso de razonamiento de los modelos desplegados en sectores críticos. Esto no es especulación; es la dirección que ya marcan iniciativas como el Acto de IA Europeo y los lineamientos del NIST en Estados Unidos.

En el contexto latinoamericano, las empresas que se posicionen como adoptantes tempranas de estas prácticas no solo cumplirán con regulaciones futuras, sino que ganarán la confianza de socios internacionales y clientes corporativos que ya operan bajo estos estándares. La seguridad demostrable es, en 2026, un activo competitivo de primer orden.

Para organizaciones que ya despliegan o evalúan modelos como GPT-5.4 de OpenAI en entornos de trabajo profesional, el momento de implementar infraestructura de captura y análisis de trazas de razonamiento es ahora, no cuando la regulación lo exija.

Tres acciones concretas para esta semana

Primero: audita tus despliegues actuales de modelos de razonamiento e identifica cuáles tienen acceso a trazas de pensamiento y cuáles no. Segundo: establece una política interna de retención de trazas de razonamiento para cualquier decisión de alto impacto tomada por un modelo de IA. Tercero: incorpora en tu proceso de evaluación de proveedores de IA la pregunta explícita: ¿qué acceso me da a la cadena de pensamiento de su modelo? Si la respuesta es ninguno, ese proveedor no cumple con los estándares mínimos de 2026.

Puntos Clave

OpenAI ha hecho algo infrecuente en la industria tecnológica: publicar una limitación de sus modelos como un argumento de confianza. La incapacidad de los sistemas de razonamiento para manipular su propia cadena de pensamiento es, en este momento histórico de la IA, la mejor garantía disponible de que lo que el modelo “piensa” es lo que realmente procesa. En iamanos.com diseñamos arquitecturas de IA que aprovechan exactamente este tipo de garantías técnicas para construir sistemas auditables, seguros y listos para los entornos regulatorios que ya se aproximan. Si tu organización necesita pasar de experimentar con IA a desplegarla con confianza real, este es el momento de actuar. No esperes al próximo paper; actúa con la inteligencia que ya tienes disponible.

Lo que necesitas saber

Es el rastro de pasos intermedios de razonamiento que un modelo genera antes de producir su respuesta final. Permite entender el proceso lógico que siguió el modelo para llegar a una conclusión determinada, y es fundamental para la auditoría y supervisión de sistemas de IA.

OpenAI descubrió que los modelos de razonamiento tienen serias dificultades para manipular deliberadamente su propia cadena de pensamiento. Cuando se les instruye para mostrar un razonamiento diferente al que realmente siguen, no logran mantener esa disociación de forma consistente, lo que valida el uso de la cadena de pensamiento como mecanismo de monitorización.

Porque implica que el rastro de razonamiento visible es auténtico y no puede ser falsificado de forma eficiente. Esto hace que la supervisión humana basada en revisar ese rastro sea genuinamente informativa, lo que reduce el riesgo de que un modelo oculte comportamientos problemáticos detrás de una apariencia de razonamiento seguro.

Deben implementar infraestructura de captura y retención de trazas de razonamiento en todos los despliegues de modelos de alto impacto. También deben incorporar el análisis de esas trazas en sus procesos de auditoría interna y exigir a sus proveedores de IA acceso explícito a la cadena de pensamiento de los modelos que utilizan.

No de forma completa. Aunque la dificultad de manipulación activa es una salvaguarda importante, persisten riesgos de opacidad estructural donde el modelo no sabe por qué tomó cierta decisión. Por eso, la monitorización de la cadena de pensamiento debe combinarse con otras capas de supervisión dentro de un marco de gobernanza integral.

Los sectores con mayor urgencia son finanzas, salud, seguridad y cualquier entorno regulado donde las decisiones de IA tengan consecuencias de alto impacto. En estos contextos, la auditabilidad del proceso de razonamiento ya está siendo considerada como requisito en marcos regulatorios emergentes tanto en Europa como en Norteamérica.

- https://openai.com/index/reasoning-models-chain-of-thought-controllability

Convierte este conocimiento en resultados

Nuestro equipo implementa soluciones de IA para empresas B2B. Agenda una consultoría gratuita.