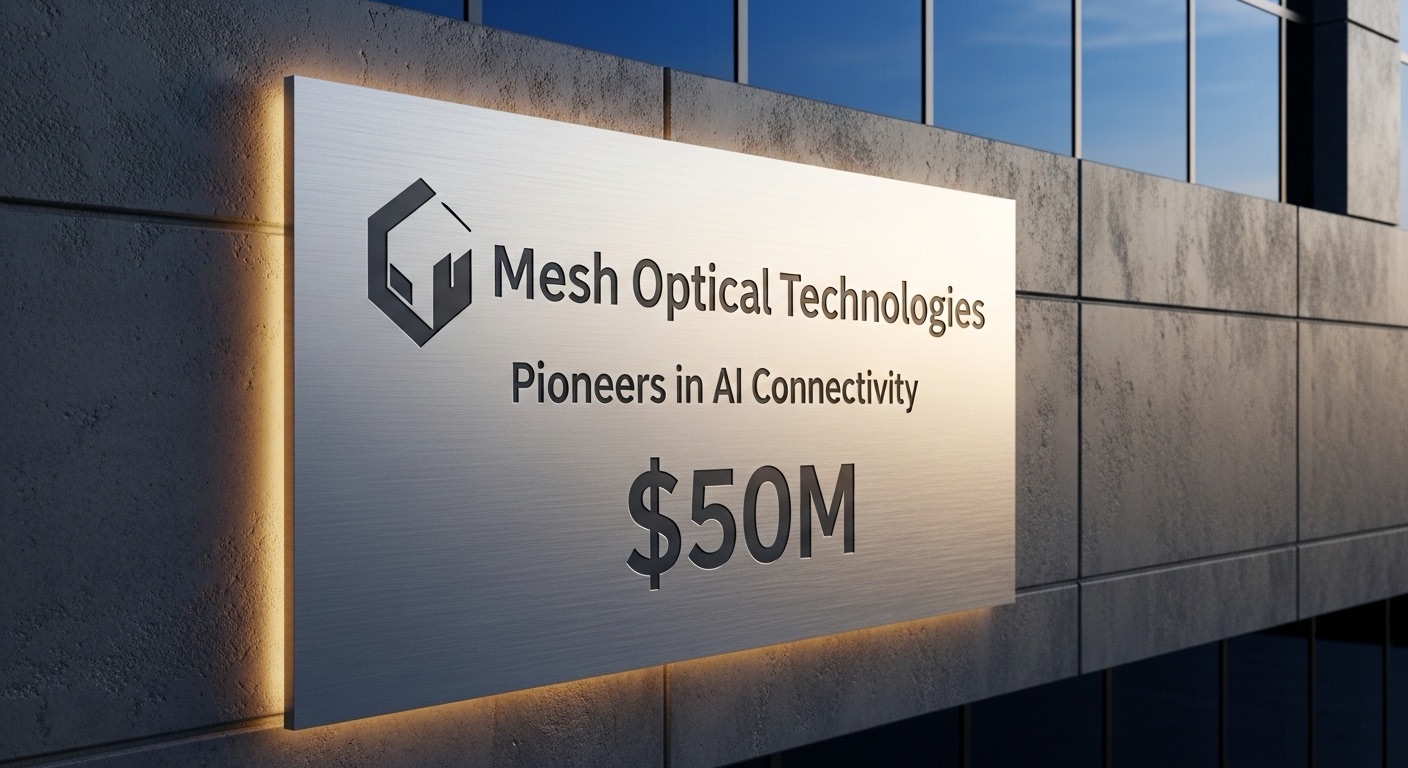

La infraestructura que soporta la Inteligencia Artificial de vanguardia es tan crítica como los algoritmos mismos. En este 2026, una noticia disruptiva surge desde Los Ángeles: Mesh Optical Technologies, una startup fundada por ex-ingenieros de SpaceX (Travis Brashears, Cameron Robinson y Serena Grown-Haeberli), ha asegurado una ronda de inversión Serie A de 50 millones de dólares, liderada por Thrive Capital. Esta inyección de capital está destinada a revolucionar la producción de transceptores ópticos, componentes esenciales para el despliegue a gran escala de Modelos de Lenguaje (LLM) y otras aplicaciones de aprendizaje profundo. Su origen no es menor; estos ingenieros colaboraron en SpaceX desarrollando los enlaces de comunicación óptica que mantienen a miles de satélites Starlink en contacto constante. Esa experiencia ahora se volca en la base de la computación inteligente terrestre. Este movimiento subraya la maduración del ecosistema de la IA, donde la innovación se extiende más allá del software y los chips de procesamiento, hacia la columna vertebral de la conectividad de datos. Para los líderes tecnológicos, entender esta capa fundamental es crucial para planificar futuras expansiones y eficiencias. Para una visión más amplia de las innovaciones en hardware, explore nuestras Noticias de IA.

La Génesis: De las Órbitas Terrestres a los Centros de Datos

Travis Brashears, Cameron Robinson y Serena Grown-Haeberli, quienes ahora fungen como CEO, Presidente y Vicepresidenta de Producto respectivamente, identificaron la oportunidad mientras diseñaban una nueva generación de satélites SpaceX que demandaban una capacidad de cómputo inmensa. Se percataron de las limitaciones del mercado de transceptores ópticos existentes. Estos dispositivos son vitales porque convierten las señales ópticas de fibra o láser en señales eléctricas que las computadoras pueden procesar, permitiendo que múltiples Unidades de Procesamiento Gráfico (GPU) trabajen en conjunto. Brashears explica la magnitud: “Alguien presumirá de un clúster de un millón de GPU; deben multiplicar por cuatro o cinco el número de transceptores en ese clúster”, según cita TechCrunch AI. Este dato revela la enorme escala de la infraestructura subyacente que requiere la IA moderna, una escala que exige una evolución radical en los componentes de interconexión.