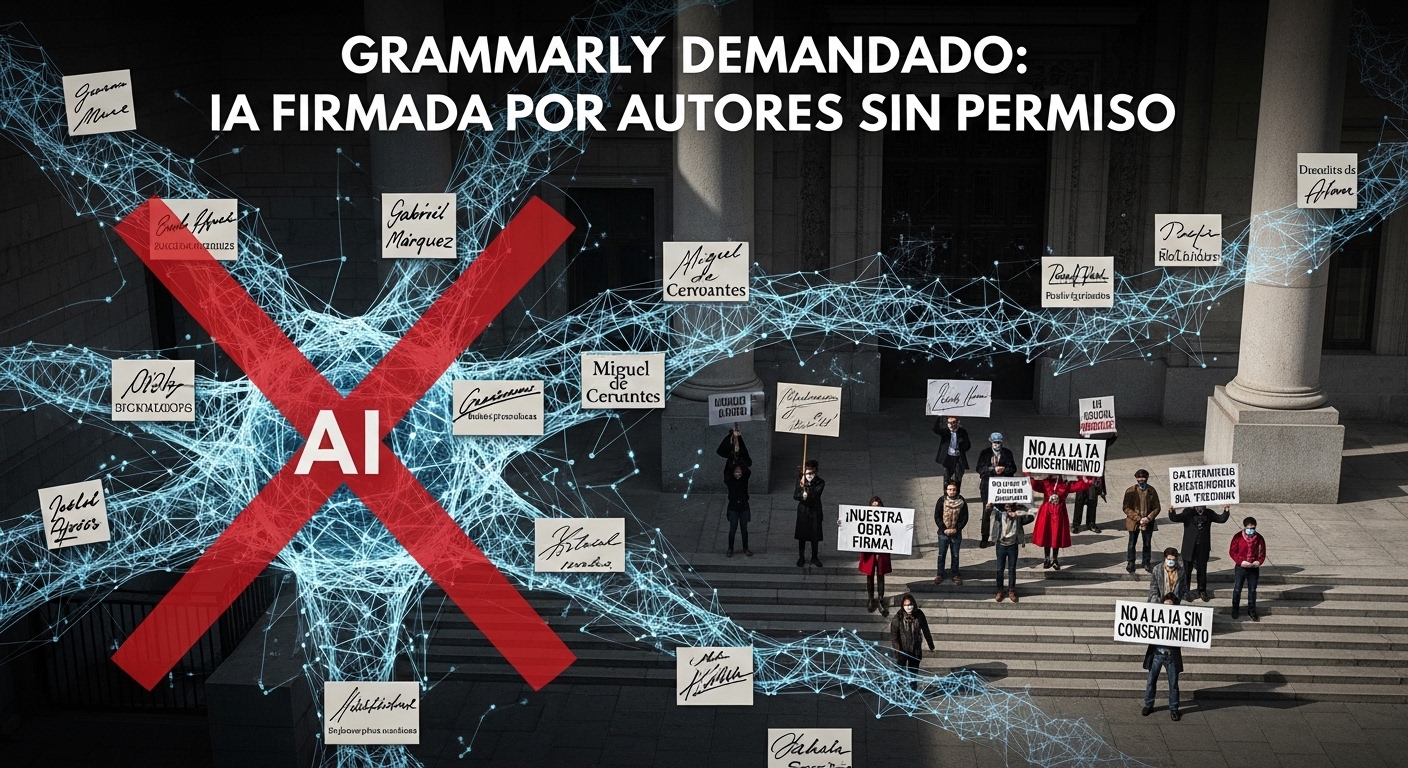

Grammarly demandada: IA firmó por autores sin permiso

Grammarly demandada: IA firmó por autores sin permiso

Desde el corazón de la CDMX pero con el conocimiento experto de Estados Unidos, iamanos.com analiza para ti el impacto real de la Inteligencia Artificial hoy. Una herramienta de escritura asistida por IA acaba de cruzar la línea que separa la innovación del fraude legal. Grammarly no solo usó inteligencia artificial para corregir textos: presentó esas correcciones bajo la identidad de autores y académicos reales sin su permiso. El caso llega en el momento más crítico para la gobernanza de la IA en 2026 y define un precedente que toda empresa que desarrolle productos de IA debe conocer hoy.

Qué ocurrió exactamente con la función de revisión experta de Grammarly

La función denominada en español como “revisión experta” de Grammarly prometía a sus usuarios algo atractivo: recibir retroalimentación editorial como si un autor o académico de renombre estuviera leyendo su texto. El problema no era la promesa en sí, sino cómo Grammarly la materializaba técnicamente. La plataforma utilizaba modelos de lenguaje para generar sugerencias de edición y las presentaba bajo el nombre, imagen o perfil de personas reales —escritores, académicos, periodistas— sin haber obtenido su consentimiento explícito para ello.

Según reportó Wired AI en su cobertura del caso, la empresa desactivó la función el mismo día en que la demanda colectiva se hizo pública. Esta reacción inmediata —aunque comprensible desde el punto de vista de relaciones públicas— fue interpretada por analistas legales como un reconocimiento tácito de la vulnerabilidad de su posición.

Desde la perspectiva técnica, lo que Grammarly hizo es lo que en ingeniería de inteligencia artificial se llama “personalización de salida mediante personas de referencia”: un patrón de diseño donde el modelo ajusta su tono, vocabulario y estilo de retroalimentación para emular a un perfil específico. El error crítico fue asociar esa emulación a identidades reales y verificables sin un marco legal de consentimiento.

El patrón técnico que generó la responsabilidad legal

Los modelos de lenguaje modernos son capaces de imitar estilos con notable precisión. Cuando una empresa decide anclar esa imitación a una persona pública específica —en lugar de un personaje ficticio o un arquetipo anónimo— entra en territorio legal extremadamente delicado. Grammarly, al parecer, no estableció acuerdos contractuales con los individuos cuyas identidades fueron utilizadas como “revisores expertos”. Esto implica potenciales violaciones en tres dimensiones: derecho de imagen, propiedad intelectual sobre el estilo editorial de cada persona, y en algunos marcos legales, fraude al consumidor por representar falsamente el origen de una recomendación.

Por qué desactivar la función no detiene el proceso legal

Un error frecuente en empresas tecnológicas es asumir que retirar un producto problemático elimina la exposición legal. En este caso, la demanda colectiva cubre el período en que la función estuvo activa y los usuarios pagaron por ella bajo la expectativa de recibir retroalimentación de expertos reales. Desde el punto de vista procesal, la desactivación puede interpretarse como evidencia de conocimiento del problema, lo que potencialmente agrava la posición de Grammarly ante el tribunal.

El contexto regulatorio que hace este caso especialmente relevante en 2026

En 2026, el ecosistema de regulación de inteligencia artificial está en un punto de inflexión. La Unión Europea ya tiene su Reglamento de IA en fase de aplicación escalonada. Estados Unidos avanza en legislación estatal —California a la vanguardia— y el debate sobre la responsabilidad de las plataformas de IA que generan contenido en nombre de personas reales está en el centro de la agenda legislativa.

**La predicción más inquietante para el sector: antes de que termine 2026, más del 40% de las herramientas de escritura asistida por IA que operan en mercados anglosajones enfrentarán revisiones legales sobre el uso de identidades reales en sus funciones de personalización.** No es una advertencia académica; es la dirección que marcan el caso Grammarly y al menos tres litigios similares en curso en el espacio de la IA generativa.

El caso se conecta directamente con lo que hemos documentado en nuestro análisis previo sobre Grammarly y la suplantación de identidades con IA, donde advertimos que esta tendencia de personalización no regulada era una bomba de tiempo legal para toda la industria.

Qué dice el marco legal vigente sobre identidades digitales e inteligencia artificial

El concepto legal de “right of publicity” —derecho de publicidad o derecho a la propia imagen comercial— es central en este litigio. En la mayoría de jurisdicciones de Estados Unidos, una persona tiene derecho a controlar el uso comercial de su nombre, voz, imagen o cualquier otro aspecto de su identidad. Cuando Grammarly presentó retroalimentación generada por un modelo de lenguaje bajo el nombre de un académico real, potencialmente comercializó esa identidad sin licencia. La novedad del caso es que el “producto” vendido era la credibilidad de esa identidad, no una imagen o un audio, lo que abre un frente jurídico prácticamente inédito.

La ola de litigios que viene para las herramientas de escritura con inteligencia artificial

Este caso no es un incidente aislado. Es el síntoma de un diseño de producto que priorizó el atractivo comercial sobre la arquitectura ética y legal. Herramientas que ofrecen “retroalimentación al estilo de” un experto real, plataformas que generan cartas de presentación “como las escribiría” un reclutador específico, o sistemas que imitan el tono de un líder de opinión sin consentimiento: todos comparten la misma vulnerabilidad estructural que hoy pone a Grammarly en el banquillo. Nuestra recomendación para cualquier equipo de producto en 2026: si tu función de IA emula a una persona real, necesitas un contrato antes de lanzar, no después del litigio.

Lo que los directivos de tecnología y producto deben hacer ahora mismo

Si eres Director de Tecnología, Director de Producto o CEO de una empresa que desarrolla o integra herramientas de inteligencia artificial en 2026, el caso Grammarly es tu señal de alarma más concreta del año. No porque Grammarly sea una empresa descuidada —es una de las plataformas de escritura asistida más sofisticadas del mercado— sino porque este error puede ocurrirle a cualquier equipo que priorice la velocidad de lanzamiento sobre la revisión legal de sus flujos de datos e identidades.

Las lecciones operativas son precisas. Primero: audita ahora mismo cualquier función de tu producto que utilice nombres, imágenes, estilos o perfiles de personas reales para personalizar la salida de tus modelos. Segundo: establece un proceso de consentimiento verificable y documentado antes de asociar cualquier identidad real a la salida de un modelo de inteligencia artificial. Tercero: distingue claramente entre “emular un estilo genérico” y “representar a una persona específica”. La línea legal entre ambos es la diferencia entre innovación y litigio.

En nuestro análisis sobre el diseño seguro de agentes de IA de OpenAI documentamos cómo la arquitectura de los sistemas de inteligencia artificial debe incorporar salvaguardas desde la fase de diseño, no como parche posterior. El mismo principio aplica aquí: la protección de identidades debe ser un requisito funcional, no una consideración legal reactiva.

Tres preguntas que todo equipo de producto debe responder hoy

¿Tu modelo genera salidas bajo el nombre o perfil de una persona real? Si la respuesta es sí, necesitas un acuerdo de licencia o consentimiento documentado. ¿Tu función de personalización le hace creer al usuario que una persona real revisó su trabajo? Si la experiencia de usuario implica esa percepción, tienes exposición por representación falsa. ¿Tienes documentado el proceso por el cual seleccionaste las identidades o estilos de referencia para tu función? La ausencia de esa documentación será tu mayor debilidad en un proceso legal. Estas tres preguntas no son hipotéticas en 2026; son las que cualquier firma de litigación tecnológica formulará en su primera reunión de descubrimiento.

La gobernanza de identidades como ventaja competitiva sostenible

Hay una lectura positiva en este episodio para las empresas que ya operan con marcos de gobernanza de inteligencia artificial robustos. En un mercado donde la confianza del usuario se está convirtiendo en el activo más escaso, las organizaciones que puedan demostrar que sus sistemas de IA respetan la identidad, el consentimiento y la transparencia tendrán una ventaja competitiva real. Como hemos analizado en nuestro reporte sobre gobernanza de IA en la banca con IBM, la arquitectura de cumplimiento no es un costo regulatorio: es diferenciación estratégica. El caso Grammarly confirma que esta lógica aplica en todos los verticales, no solo en el sector financiero.

El impacto en la industria de herramientas de escritura asistida por inteligencia artificial

El mercado global de herramientas de escritura asistida por inteligencia artificial superó los 6,000 millones de dólares en 2025 y proyectaba tasas de crecimiento de doble dígito para 2026 y 2027. La demanda contra Grammarly —que cuenta con más de 30 millones de usuarios activos— introduce una variable de riesgo legal que ningún modelo de proyección había incorporado con suficiente peso.

Las consecuencias inmediatas serán visibles en tres dimensiones. En el plano de producto, veremos una oleada de auditorías internas en empresas como Jasper, Notion AI, Microsoft Copilot para Word y cualquier plataforma que ofrezca retroalimentación personalizada. En el plano legal, los estudios de abogados especializados en tecnología anticipan un incremento significativo en consultas sobre diseño de funciones de personalización. En el plano de confianza del usuario, la pregunta “¿quién realmente revisó mi texto?” se convertirá en un criterio de selección de herramientas para segmentos profesionales y académicos.

Tal como hemos señalado en nuestro análisis sobre los límites del aprendizaje profundo y la necesidad de marcos más transparentes en inteligencia artificial, la industria está llegando a un punto donde la sofisticación técnica sin arquitectura ética genera pasivos que superan los activos de crecimiento. El caso Grammarly es el ejemplo más concreto de este principio en la primera mitad de 2026.

Puntos Clave

El caso de Grammarly no es solo una noticia legal. Es una radiografía del estado de madurez —o su ausencia— en la relación entre herramientas de inteligencia artificial y los derechos de las personas reales cuyas identidades alimentan sus promesas de valor. En iamanos.com, trabajamos con organizaciones que quieren crecer con inteligencia artificial de manera sostenible: con arquitecturas que sean técnicamente sólidas, legalmente defensibles y éticamente coherentes. Porque en 2026, la diferencia entre una empresa líder en IA y una empresa en litigio por IA no está en la potencia de sus modelos. Está en la calidad de sus decisiones de diseño. ¿Tu empresa tiene esa claridad? Contáctanos hoy.

Lo que necesitas saber

Grammarly utilizó modelos de inteligencia artificial para generar sugerencias de edición y las presentó a los usuarios bajo el nombre o perfil de autores y académicos reales, sin haber obtenido el consentimiento de esas personas para usar su identidad como parte del producto.

Porque la demanda colectiva cubre el período en que la función estuvo activa y los usuarios pagaron por ella. Retirar el producto puede incluso interpretarse como reconocimiento tácito del problema, lo que no favorece la posición legal de la empresa ante el tribunal.

Cualquier función que asocie la salida de un modelo de inteligencia artificial a la identidad de una persona real requiere un acuerdo de consentimiento documentado antes del lanzamiento. La revisión legal debe ser un requisito funcional del diseño de producto, no una reacción a una demanda.

Afecta a cualquier producto de inteligencia artificial que personalice su salida usando identidades, estilos o perfiles de personas reales sin consentimiento. Esto incluye asistentes de correo electrónico, herramientas de presentación, plataformas de retroalimentación educativa y sistemas de recomendación editorial.

Estableciendo tres salvaguardas básicas: primero, un inventario de todas las identidades reales utilizadas en funciones de personalización; segundo, acuerdos de licencia o consentimiento verificables para cada una; y tercero, una experiencia de usuario que comunique con transparencia cuándo una retroalimentación es generada por un modelo de inteligencia artificial y no por una persona real.

Convierte este conocimiento en resultados

Nuestro equipo implementa soluciones de IA para empresas B2B. Agenda una consultoría gratuita.