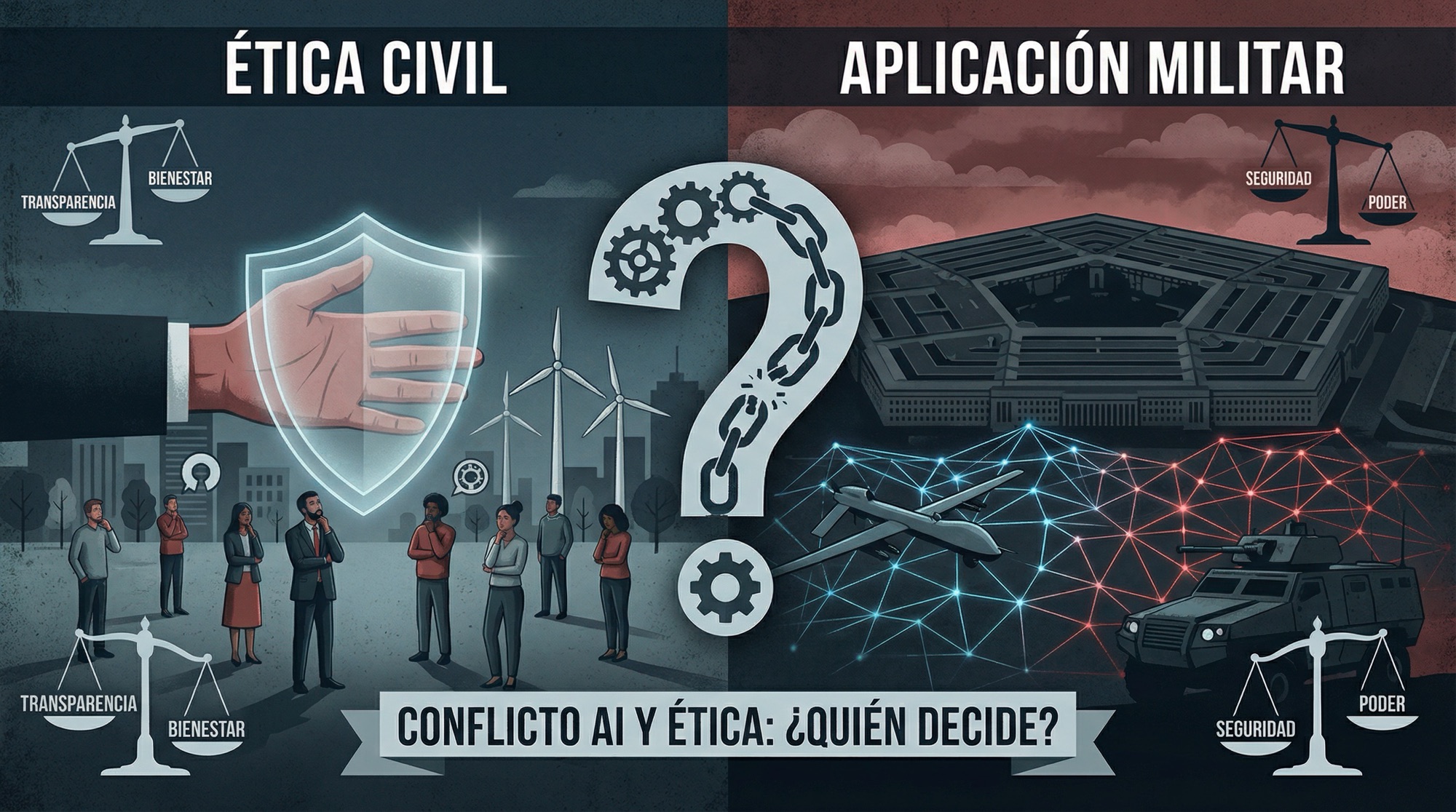

Según un informe de Axios, el Pentágono está presionando a las empresas de IA para que permitan al ejército estadounidense utilizar su tecnología para “todos los fines legales”. Sin embargo, Anthropic, la empresa detrás del modelo-ia-generativa/) de lenguaje Claude, se resiste a esta exigencia. Esta disputa pone de manifiesto las crecientes tensiones entre el desarrollo de la IA y su aplicación en el ámbito militar en 2026.

El Dilema Ético de Anthropic

Anthropic, conocida por su enfoque en la seguridad y la ética de la IA, ha expresado reservas sobre cómo el Pentágono podría utilizar Claude. Según Axios, Anthropic está particularmente preocupada por los “límites estrictos en torno a las armas totalmente autónomas y la vigilancia masiva interna”. Esta postura contrasta con la de otras empresas, como OpenAI y Google, que parecen estar más dispuestas a ceder a las demandas del gobierno estadounidense. La posición de Anthropic podría sentar un precedente importante para el futuro de la regulación de la IA en el sector militar.

La Amenaza del Pentágono de Retirar un Contrato de $200 Millones

Ante la resistencia de Anthropic, el Pentágono está amenazando con cancelar su contrato de $200 millones con la empresa de IA. Esta amenaza subraya la importancia estratégica que el gobierno estadounidense concede al acceso a la tecnología de IA y su disposición a ejercer presión económica para lograr sus objetivos. La pérdida de este contrato podría tener un impacto significativo en la capacidad de Anthropic para seguir desarrollando y mejorando Claude. Para entender mejor las opciones de financiamiento y desarrollo de IA, consulta nuestra guía sobre Herramientas de IA.