En 2026, las empresas que basan decisiones críticas en un solo sistema de inteligencia artificial están apostando a una sola carta en un juego de alto riesgo. Las alucinaciones —respuestas incorrectas pero presentadas con total confianza— siguen siendo el talón de Aquiles de todos los grandes modelos de lenguaje del mercado: ChatGPT, Gemini, Claude y Grok incluidos. Ninguno es infalible. Ninguno debería serlo en solitario.

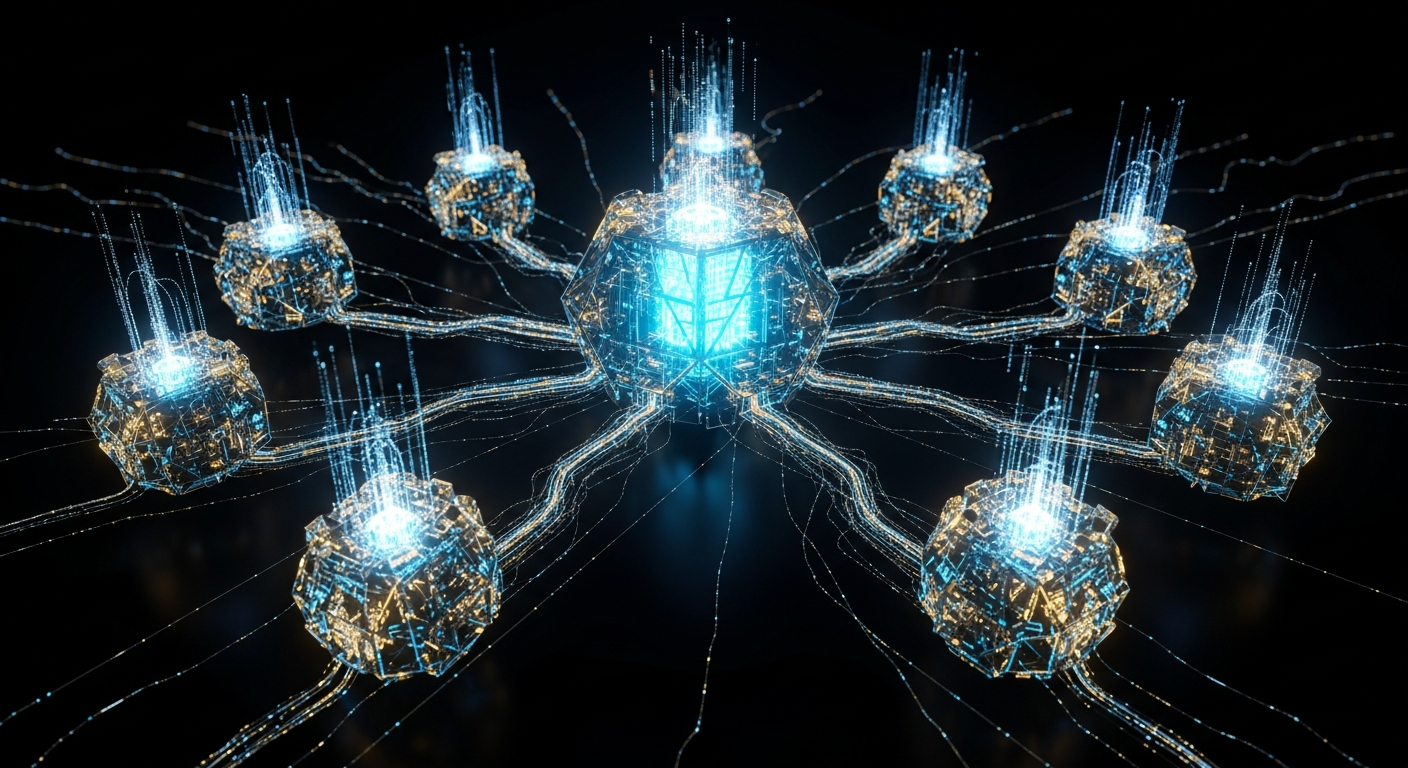

CollectivIQ, la startup detrás de esta apuesta, identificó un patrón crítico: cuando los modelos de lenguaje discrepan entre sí ante una misma pregunta, esa divergencia en sí misma es información valiosa. Y cuando convergen, la confianza en la respuesta se dispara exponencialmente. El resultado es una plataforma que agrega hasta diez modelos de forma simultánea, procesa sus respuestas y entrega al usuario un análisis contrastado, no una sola voz.

Según el reporte de TechCrunch AI, este enfoque de “consenso de chatbots” busca directamente atacar los dos vectores de falla más costosos en implementaciones empresariales: el sesgo del modelo y la alucinación factual. Dos problemas que, en entornos de salud, finanzas o derecho, pueden costar millones.

¿Por qué un solo modelo de lenguaje es un riesgo empresarial?

Cada modelo de lenguaje grande tiene sesgos codificados en su proceso de entrenamiento: los datos que consumió, las preferencias de sus anotadores humanos, las decisiones de alineamiento de su empresa creadora. GPT-5 de OpenAI tiene sesgos distintos a Claude 3.7 de Anthropic, que a su vez difiere de Gemini 2.5 de Google. Esto no es un defecto de diseño: es una consecuencia inevitable de cómo se construyen estos sistemas. El error estratégico está en tratarlos como oráculos únicos. Un CEO que delega análisis jurídico, prospección de mercado o síntesis científica a un solo modelo está operando con un punto único de falla intelectual. CollectivIQ convierte ese punto único en un panel de expertos paralelos.

La magnitud real del problema de las alucinaciones en 2026

**Los estudios más recientes de 2026 indican que incluso los modelos de lenguaje más avanzados alucina en entre el 3% y el 8% de las consultas en dominios especializados**, una cifra que parece pequeña hasta que se escala a miles de decisiones diarias en una empresa. Para una organización que procesa 10,000 consultas de IA al mes, eso significa entre 300 y 800 respuestas potencialmente incorrectas siendo consumidas como verdades. La agregación de modelos no elimina este número a cero, pero lo reduce de forma estadísticamente significativa al requerir que múltiples sistemas independientes coincidan en la misma conclusión errónea simultáneamente.