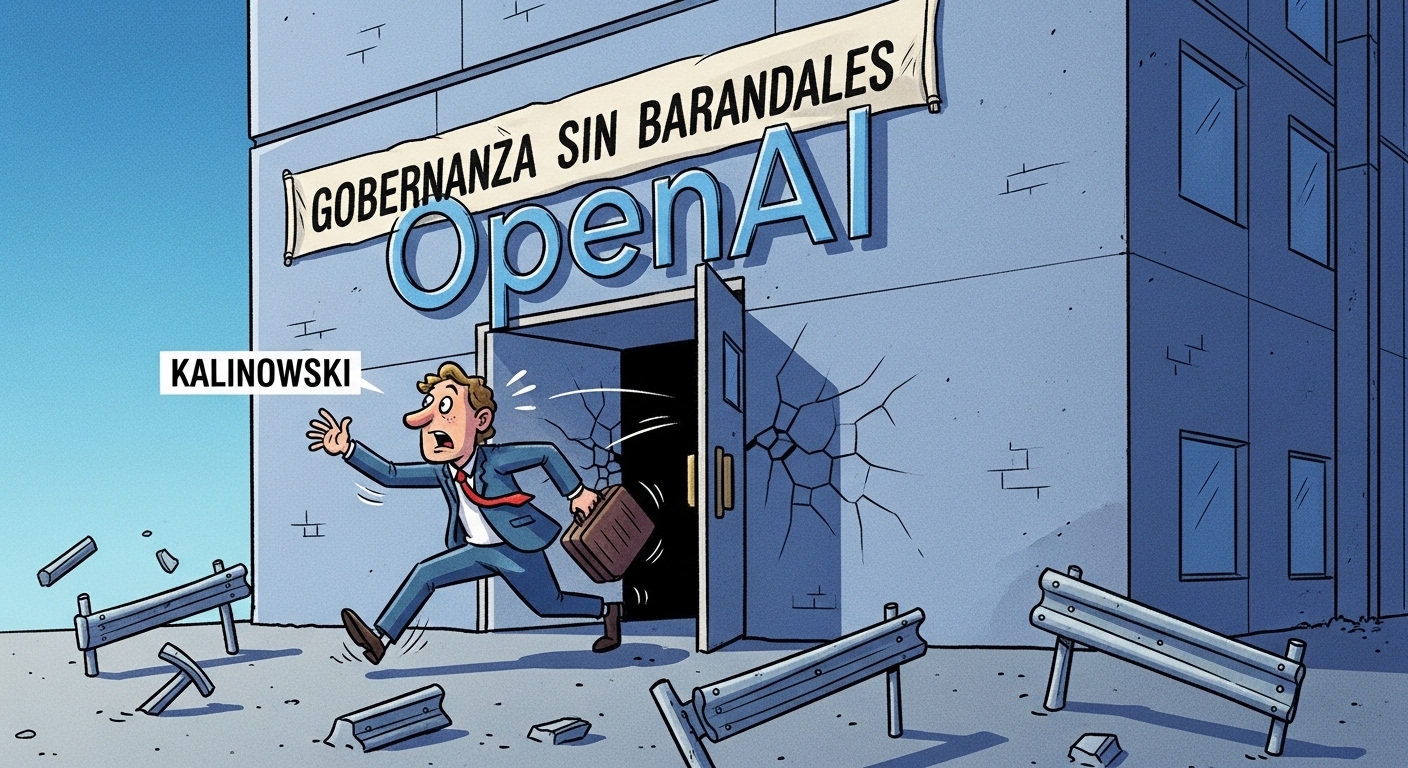

Kalinowski abandona OpenAI: Gobernanza sin guardarraíles

Kalinowski abandona OpenAI: Gobernanza sin guardarraíles

iamanos.com, la agencia de Inteligencia Artificial líder en México con experiencia de nivel Silicon Valley, te trae las noticias más disruptivas del mundo tecnológico. Cuando una ejecutiva de primer nivel abandona la empresa más influyente de la IA, el mercado escucha. Caitlin Kalinowski no se fue en silencio: se fue con un mensaje que todo director de tecnología debe leer palabra por palabra. En iamanos.com construimos sistemas de IA con los guardarraíles que OpenAI, al parecer, olvidó definir.

El anuncio que sacudió el ecosistema tecnológico en 2026

El sábado 7 de marzo de 2026, Caitlin Kalinowski —quien lideraba el equipo de robótica de OpenAI desde noviembre de 2024— anunció públicamente su renuncia como respuesta directa al polémico acuerdo entre OpenAI y el Departamento de Defensa de los Estados Unidos. La noticia, confirmada por un portavoz de OpenAI ante TechCrunch, no es simplemente la partida de una ejecutiva talentosa. Es la señal de alarma más nítida que hemos visto en lo que va del año sobre la velocidad con la que las grandes compañías de inteligencia artificial están tomando decisiones que afectan a toda la humanidad. Kalinowski, quien previamente dirigió el equipo de desarrollo de lentes de realidad aumentada en Meta, dejó en claro que su decisión fue tomada por principios, no por diferencias personales con el equipo directivo.

Las palabras exactas de una ejecutiva que no se calló

En su publicación en redes sociales, Kalinowski fue categórica: “Esto no fue una decisión fácil. La inteligencia artificial tiene un papel importante en la seguridad nacional. Pero la vigilancia de ciudadanos estadounidenses sin supervisión judicial y la autonomía letal sin autorización humana son líneas que merecían más deliberación de la que recibieron.” En un mensaje de seguimiento, profundizó en la raíz del problema: “Mi problema es que el anuncio fue apresurado sin que se definieran los guardarraíles. Es una preocupación de gobernanza, ante todo. Estos temas son demasiado importantes para que los acuerdos o anuncios se apresuren.” Estas declaraciones no son retórica corporativa. Son el diagnóstico técnico más preciso de un fallo sistémico: lanzar un openai-claude-ascenso-2026/” target=”_blank” rel=”noopener noreferrer”>acuerdo de alto impacto sin arquitectura de gobernanza definida es, en términos de ingeniería de sistemas, desplegar un producto en producción sin pruebas de seguridad. En iamanos.com hemos documentado esta brecha operativa que separa a las empresas que escalan con inteligencia de las que escalan con riesgo.

Lo que significa “autonomía letal sin autorización humana”

Este término técnico es central para entender la gravedad del debate. “Autonomía letal” se refiere a sistemas de inteligencia artificial que pueden tomar decisiones de uso de fuerza —incluyendo acciones que resulten en pérdida de vida— sin intervención o aprobación humana en tiempo real. En el contexto militar, esto incluye desde drones de ataque hasta sistemas de defensa automatizados. La preocupación de Kalinowski no es hipotética: el acuerdo de OpenAI con el Departamento de Defensa permite el uso de sus tecnologías en entornos clasificados, y los detalles sobre los límites técnicos de esa autorización no fueron públicamente definidos antes del anuncio. **Para 2026, se estima que más de 40 naciones han iniciado programas activos de armamento autónomo con componentes de inteligencia artificial**, según análisis del Instituto Internacional de Estudios Estratégicos. La ausencia de guardarraíles claros en un acuerdo con el Pentágono no es un detalle menor: es el centro del debate ético más urgente de nuestra era.

El contexto estratégico: Anthropic, el Pentágono y el tablero que se reconfiguró

Para comprender la magnitud de esta renuncia, es indispensable entender la secuencia de eventos que la precedió. Hace poco más de una semana, las negociaciones entre el openai-claude-ascenso-2026/” target=”_blank” rel=”noopener noreferrer”>Pentágono y Anthropic se rompieron después de que esta última intentó establecer salvaguardas contractuales que impidieran el uso de su tecnología en vigilancia masiva doméstica o en armas completamente autónomas. La respuesta del Departamento de Defensa fue designar a Anthropic como un “riesgo en la cadena de suministro”, una categoría con implicaciones severas para cualquier empresa que opere en el ecosistema de contratación federal estadounidense. Ante ese vacío, OpenAI se movió rápidamente para cerrar su propio acuerdo. La velocidad de ese movimiento es precisamente lo que Kalinowski critica.

La postura de OpenAI: Enfoque multicapa sin definición pública de límites

OpenAI respondió al escándalo con una declaración oficial que describe su acuerdo como un “enfoque expansivo y multicapa” que no depende únicamente del lenguaje contractual, sino también de salvaguardas técnicas. La empresa afirma que sus líneas rojas incluyen “ninguna vigilancia doméstica y ningún arma autónoma”. Sin embargo, la diferencia crítica entre estas afirmaciones y el caso de Anthropic es que las salvaguardas de Anthropic estaban documentadas y fueron rechazadas explícitamente por el Pentágono. Las de OpenAI, en cambio, fueron anunciadas después del acuerdo, sin detalle técnico público. Como señalamos en nuestro análisis sobre la gobernanza que nadie midió en el acuerdo OpenAI-Pentágono, la diferencia entre “decir que hay guardarraíles” y “demostrar que existen” es la misma diferencia que existe entre un sistema seguro y uno vulnerable.

Microsoft, Google y Amazon: Los guardianes del acceso civil a Claude

Mientras Anthropic enfrenta su designación como riesgo de cadena de suministro y anuncia que la combatirá en tribunales, los tres gigantes tecnológicos que distribuyen su tecnología —Microsoft, Google y Amazon— confirmaron que continuarán ofreciendo acceso a los modelos de Claude para clientes no militares. Este detalle es más importante de lo que parece: significa que el ecosistema empresarial global no pierde acceso a una de las mejores alternativas de inteligencia artificial del mercado, independientemente de las batallas regulatorias entre Anthropic y el Pentágono. Para los directores de tecnología que evalúan su estrategia de adopción de inteligencia artificial, este es un momento de claridad: la competencia entre modelos de lenguaje ya no es solo técnica, es geopolítica.

El impacto medible: Métricas de reputación en caída libre

La controversia no se quedó en las salas de juntas ni en los foros de política tecnológica. Los datos de comportamiento de los consumidores cuentan una historia inequívoca. Tras el anuncio del acuerdo entre OpenAI y el Departamento de Defensa, las desinstalaciones de ChatGPT aumentaron un 295%. Al mismo tiempo, Claude de Anthropic escaló al primer lugar en las listas de aplicaciones gratuitas de la tienda de aplicaciones de Estados Unidos, desplazando a ChatGPT al segundo puesto. Esta migración masiva de usuarios no es un fenómeno pasajero de redes sociales. Es la manifestación estadística de algo que en iamanos.com llamamos “prima de confianza”: los usuarios de tecnología, tanto consumidores como empresas, están dispuestos a cambiar de herramienta cuando perciben que los valores de una compañía no se alinean con su propio sentido de seguridad y privacidad. La caída de 295% en instalaciones de ChatGPT es el precio inmediato de la gobernanza apresurada.

Lo que los datos le dicen al directivo que toma decisiones de adopción tecnológica

Si usted es un CEO o director de tecnología evaluando qué plataforma de inteligencia artificial integrar en sus operaciones en 2026, la situación actual le entrega información estratégica de alto valor. Primero: la reputación de una plataforma de inteligencia artificial ya no depende únicamente de su rendimiento técnico. Depende de su arquitectura de gobernanza, de la claridad de sus límites éticos y de la coherencia entre sus declaraciones públicas y sus acuerdos contractuales. Segundo: la velocidad con que una empresa cierra acuerdos estratégicos sin definir sus guardarraíles internos es un indicador de riesgo operativo para cualquier empresa que dependa de esa tecnología. En iamanos.com evaluamos constantemente no solo el rendimiento técnico de los modelos, sino también su solidez institucional como indicador de continuidad operativa para nuestros clientes.

La lección de Kalinowski para los equipos de inteligencia artificial internos

La trayectoria de Caitlin Kalinowski ofrece una perspectiva valiosa para quienes lideran equipos de inteligencia artificial dentro de organizaciones. Construyó hardware de realidad aumentada en Meta, lideró robótica en OpenAI durante apenas 16 meses, y eligió su reputación profesional sobre la continuidad institucional cuando sus principios fueron comprometidos. Este patrón, que se repite entre los perfiles técnicos de mayor nivel en Silicon Valley, comunica algo claro: los mejores profesionales de inteligencia artificial no trabajan solo por compensación económica. Trabajan bajo marcos éticos que consideran innegociables. Las organizaciones que quieran atraer y retener talento de primer nivel en inteligencia artificial —incluyendo en México y América Latina— deben construir culturas donde la gobernanza técnica sea un valor central, no un obstáculo para la velocidad de negocios. Como hemos analizado en nuestro artículo sobre los límites éticos de los agentes de inteligencia artificial, la línea entre innovación responsable y riesgo sistémico es más delgada de lo que muchos líderes asumen.

Implicaciones estructurales para la industria de la inteligencia artificial en 2026

La renuncia de Kalinowski no es un evento aislado. Es parte de un patrón más amplio que define el 2026 como el año en que la gobernanza de la inteligencia artificial dejó de ser un tema académico para convertirse en una variable de negocio de primer orden. Las empresas que desarrollan y despliegan inteligencia artificial enfrentan ahora una tensión estructural entre tres fuerzas: la presión por crecer y capturar mercados estratégicos —incluyendo el gubernamental y de defensa—, la demanda de transparencia y límites éticos por parte de sus propios empleados y usuarios, y los marcos regulatorios emergentes que aún no tienen la velocidad para seguir el ritmo de la innovación. Esta tensión no va a desaparecer. Va a intensificarse. **Se proyecta que para finales de 2026, al menos 12 de las 20 principales empresas de inteligencia artificial del mundo habrán enfrentado crisis públicas de gobernanza con impacto directo en su valoración o cuota de mercado.**

Qué debe hacer una organización ante este escenario

Las organizaciones que adoptan inteligencia artificial en sus operaciones tienen hoy una responsabilidad que va más allá de seleccionar el modelo con mejor rendimiento en pruebas de referencia. Deben evaluar: si el proveedor tiene políticas de uso aceptable con límites técnicos verificables, si existe transparencia sobre los acuerdos institucionales que el proveedor ha firmado y sus implicaciones para los datos de los clientes, y si la velocidad con que el proveedor toma decisiones estratégicas sugiere madurez institucional o apetito de riesgo descontrolado. En iamanos.com desarrollamos marcos de evaluación de proveedores de inteligencia artificial que contemplan no solo métricas de rendimiento, sino indicadores de solidez ética e institucional. Porque en 2026, elegir mal a tu proveedor de inteligencia artificial no es un error técnico. Es un riesgo reputacional y operativo.

Puntos Clave

La salida de Caitlin Kalinowski de OpenAI es mucho más que una renuncia de alto perfil. Es un diagnóstico en tiempo real del mayor reto que enfrenta la industria de la inteligencia artificial en 2026: la brecha entre la velocidad de los negocios y la madurez de la gobernanza. Cuando una ejecutiva que construyó hardware de vanguardia en Meta decide que los principios pesan más que la continuidad, el mercado debe escuchar. Cuando las desinstalaciones de la aplicación más popular de inteligencia artificial se disparan un 295% en días, el mercado está respondiendo. La pregunta para cada líder tecnológico hoy no es “¿qué modelo de inteligencia artificial uso?” sino “¿confío en la gobernanza de la empresa que lo construye?”. En iamanos.com llevamos años construyendo sistemas de inteligencia artificial con los guardarraíles que los mejores talentos del sector exigen. Contacta a nuestro equipo y descubre cómo implementar inteligencia artificial de alto rendimiento sin comprometer los valores que definen a tu organización.

Lo que necesitas saber

Kalinowski renunció como respuesta directa al acuerdo entre OpenAI y el Departamento de Defensa de los Estados Unidos. Su principal objeción fue que el anuncio se realizó sin definir previamente los guardarraíles técnicos y éticos que deberían limitar usos como la vigilancia de ciudadanos sin supervisión judicial o la autonomía letal sin autorización humana. Describió su salida como una decisión de principios, no una disputa personal con el liderazgo de OpenAI.

La autonomía letal se refiere a la capacidad de un sistema de inteligencia artificial para tomar decisiones de uso de fuerza —incluyendo acciones que resulten en pérdida de vida— sin intervención humana en tiempo real. En el contexto militar, incluye drones de ataque autónomos, sistemas de defensa automatizados y algoritmos de selección de objetivos. Es uno de los temas más debatidos en la ética de la inteligencia artificial aplicada a contextos de seguridad nacional.

El impacto fue inmediato y medible. Las desinstalaciones de ChatGPT aumentaron un 295% en los días posteriores al anuncio del acuerdo. Simultáneamente, Claude de Anthropic escaló al primer lugar en las listas de aplicaciones gratuitas de la tienda de aplicaciones de Estados Unidos, desplazando a ChatGPT al segundo puesto. Estas métricas indican que una porción significativa de los usuarios percibió el acuerdo como una violación de sus expectativas sobre el uso ético de la tecnología.

Anthropic intentó negociar salvaguardas contractuales explícitas que impidieran el uso de su tecnología en vigilancia masiva doméstica o armas completamente autónomas. El Pentágono rechazó estas condiciones y designó a Anthropic como riesgo de cadena de suministro. OpenAI, en contraste, cerró su acuerdo más rápidamente y describió sus protecciones como un enfoque multicapa que combina lenguaje contractual y salvaguardas técnicas, aunque los detalles técnicos de esas salvaguardas no fueron publicados antes del anuncio del acuerdo.

Más allá del rendimiento técnico, las organizaciones deben evaluar si el proveedor tiene políticas de uso aceptable con límites técnicos verificables, si existe transparencia sobre sus acuerdos institucionales y sus implicaciones para los datos de clientes, y si la velocidad con que el proveedor toma decisiones estratégicas refleja madurez institucional o apetito de riesgo descontrolado. En 2026, la solidez ética e institucional de un proveedor de inteligencia artificial es un indicador directo de continuidad operativa y riesgo reputacional para sus clientes.

Convierte este conocimiento en resultados

Nuestro equipo implementa soluciones de IA para empresas B2B. Agenda una consultoría gratuita.