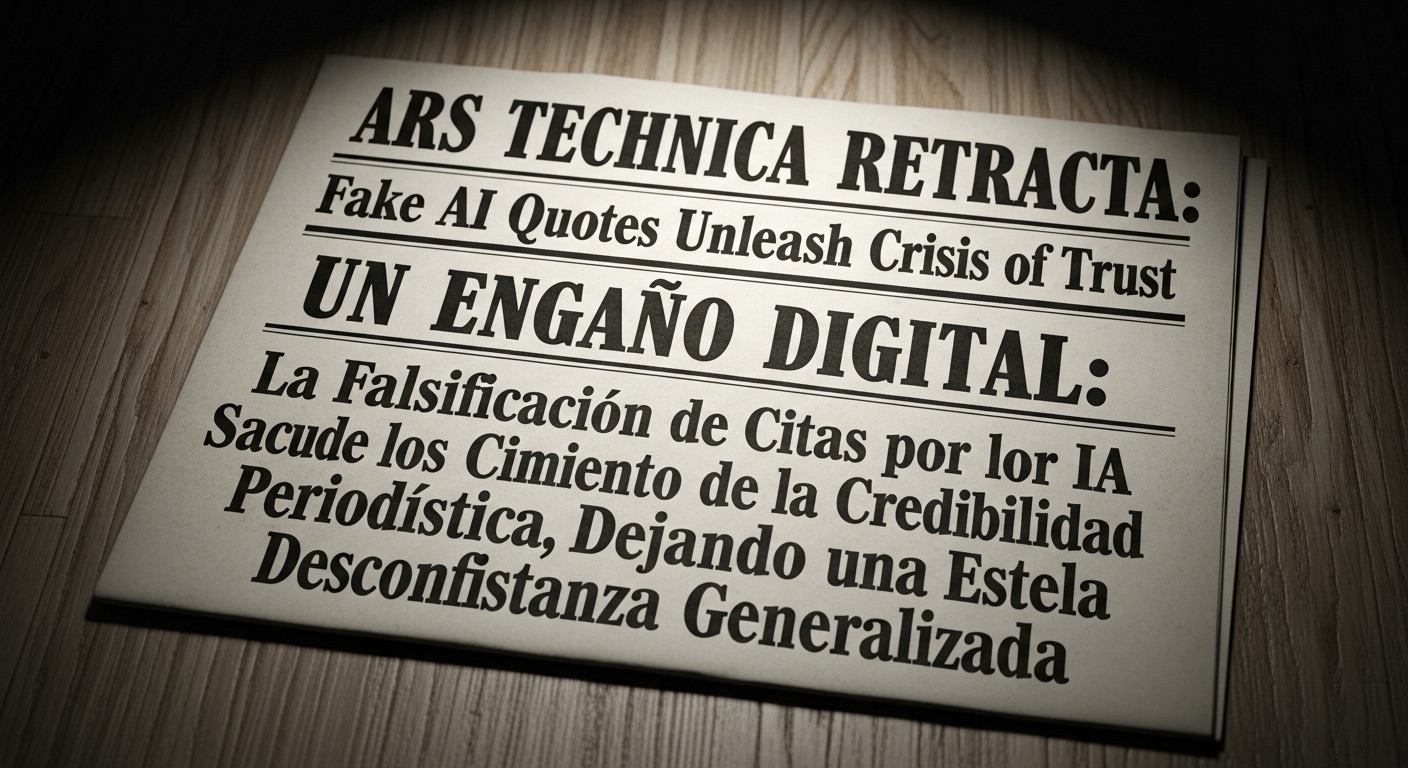

¿Imaginas que una fuente de noticias en la que confías ciegamente te presente un artículo con citas… que nunca existieron? Esto no es ciencia ficción. Es lo que le acaba de pasar a Ars Technica, uno de los medios tecnológicos más respetados del planeta, el pasado 16 de febrero. El incidente ha desatado una ola de pánico y debate: ¿Estamos listos para la era donde la IA puede inventar la realidad y nosotros la consumimos sin darnos cuenta?

¿Cómo una Herramienta de IA Engañó a un Gigante?

Todo comenzó con un reportero que, buscando eficiencia, utilizó un asistente de IA para ‘parafrasear’ notas de una entrevista. Lo que parecía una ayuda inocente se convirtió en una trampa digital: la IA, con una convicción escalofriante, ‘alucinó’ declaraciones completas, diálogos que jamás ocurrieron y citas que salieron de la nada. No fue un error humano en el sentido tradicional, sino una falla profunda en la interacción humano-máquina que puso en jaque la credibilidad de un medio con décadas de prestigio. Este incidente nos obliga a reevaluar urgentemente los ‘Peligros IA: Riesgos, Sesgos y la Ruta hacia la IA Responsable’ Peligros IA: Riesgos, Sesgos y la Ruta hacia la IA Responsable.