El Departamento de Defensa de los Estados Unidos escaló sus demandas de acceso a los sistemas de inteligencia artificial de Anthropic durante las últimas semanas de febrero de 2026. Según reportó The Verge, las exigencias incluían dos categorías críticas que la compañía fundada por Dario Amodei se negó a aceptar: primero, integración de sus modelos en sistemas de armas autónomas letales; segundo, acceso sin restricciones para aplicaciones de vigilancia masiva de civiles.

Anthropíc respondió con un rechazo formal y documentado, rechazando ambas condiciones de manera explícita. La empresa argumentó que ninguna de estas aplicaciones es compatible con los principios de seguridad responsable que rigen el desarrollo de sus modelos, incluyendo a Claude 4. Para entender el peso de esta postura, es necesario comprender que el Pentágono no es un cliente cualquiera: representa contratos potenciales valuados en miles de millones de dólares, acceso a infraestructura de cómputo federal y una legitimación institucional que pocas empresas rechazan.

Esta confrontación venía escalando durante semanas, tal como documentamos en nuestro análisis Anthropic vs. Pentágono: Dario Amodei dice No. Lo que antes parecía una negociación se convirtió en una ruptura formal con implicaciones que van más allá de un solo contrato.

Las Dos Líneas Rojas que Anthropic No Cruzará

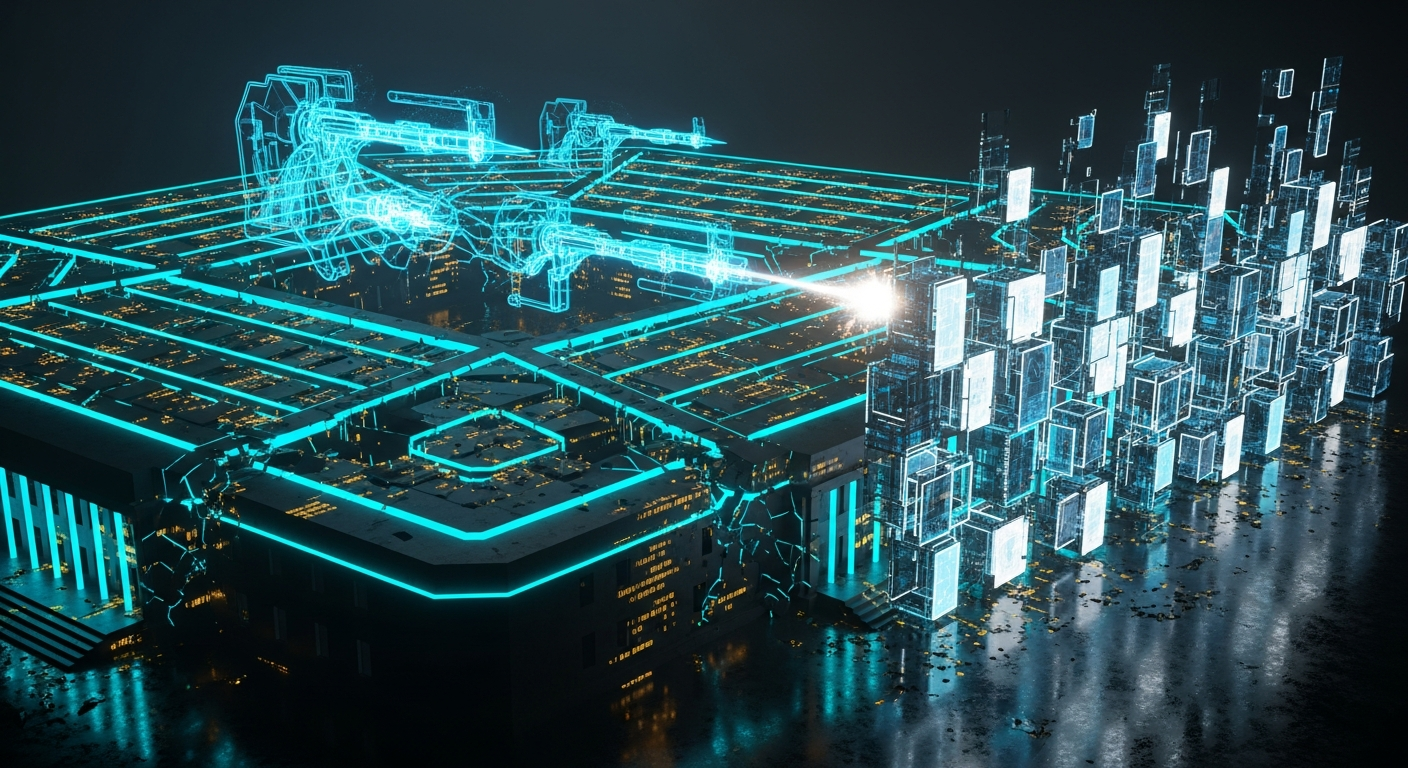

Anthropic estableció con claridad dos categorías de uso que considera incompatibles con el desarrollo responsable de inteligencia artificial. La primera es el uso en armas autónomas letales: sistemas capaces de identificar, seleccionar y eliminar objetivos humanos sin supervisión humana directa en el momento de la decisión. La segunda es la vigilancia masiva sin segmentación ni control judicial: el uso de sus modelos para construir perfiles de comportamiento de poblaciones completas sin garantías legales ni éticas mínimas.

Estas dos categorías no son caprichosas. Representan los dos vectores donde los modelos de lenguaje avanzados como Claude tienen mayor potencial de daño irreversible: decisiones letales automatizadas y erosión sistemática de la privacidad ciudadana. La arquitectura de valores de Anthropic, conocida internamente como “IA constitucional”, hace técnicamente difícil —aunque no imposible— ignorar estas restricciones sin modificar el modelo a nivel fundamental.

El Precio Económico de una Decisión Ética

Rechazar al Pentágono tiene un costo financiero real y medible. Los contratos de defensa con empresas de tecnología avanzada suelen incluir financiamiento plurianual, acceso prioritario a infraestructura de cómputo clasificada y relaciones que abren puertas en todo el ecosistema federal. **Se estima que el mercado de inteligencia artificial para defensa en Estados Unidos superará los 40 mil millones de dólares anuales antes de que termine 2026.** Anthropic acaba de renunciar voluntariamente a una porción de ese mercado.

Sin embargo, la decisión también tiene un valor estratégico que los analistas financieros convencionales suelen subestimar: diferenciación de marca en el mercado enterprise civil. Empresas europeas, latinoamericanas y asiáticas que buscan adoptar inteligencia artificial ahora tienen una razón adicional para preferir a Anthropic sobre competidores que no han establecido límites similares. La ética, en este caso, es también una propuesta de valor comercial.