Claude de Anthropic: Microsoft, Google y AWS protegen el acceso civil

Claude de Anthropic: Microsoft, Google y AWS protegen el acceso civil

Desde el corazón de la CDMX pero con el conocimiento experto de Estados Unidos, iamanos.com analiza para ti el impacto real de la Inteligencia Artificial hoy. El choque entre el Pentágono y Anthropic es la crisis geopolítica más relevante del ecosistema de IA en lo que va de 2026. Las líneas entre ética, negocio y seguridad nacional nunca estuvieron tan tensas. En iamanos.com no solo cubrimos la noticia: te explicamos qué decisiones debes tomar ahora mismo como líder empresarial.

El Enfrentamiento entre el Pentágono y Anthropic: Cronología de una Crisis

El jueves 5 de marzo de 2026, el Departamento de Defensa de los Estados Unidos —renombrado oficialmente como Departamento de Guerra por la administración Trump— dio un paso sin precedentes en la historia tecnológica reciente: designó formalmente a Anthropic como un riesgo de cadena de suministro. Esta categoría, históricamente reservada para adversarios extranjeros como Huawei o ZTE, jamás había sido aplicada a una empresa emergente de inteligencia artificial con sede en San Francisco.

El detonante fue una negativa directa. El Pentágono solicitó a Anthropic acceso irrestricto a su modelo Claude para aplicaciones que la compañía consideró incompatibles con sus principios de seguridad: vigilancia masiva de poblaciones y el despliegue de armas completamente autónomas, es decir, sistemas capaces de identificar y eliminar objetivos sin supervisión humana. Anthropic rechazó la solicitud de forma pública y categórica.

Según TechCrunch, fuente primaria de esta noticia, la designación tiene consecuencias operativas inmediatas: el Pentágono no podrá continuar utilizando productos de Anthropic una vez que complete la transición de sus sistemas, y cualquier empresa o agencia que trabaje bajo contrato con el Departamento de Defensa deberá certificar formalmente que no emplea modelos de Anthropic en esas operaciones contratadas.

Qué significa exactamente la designación de riesgo en la cadena de suministro

En términos regulatorios, una designación de riesgo en la cadena de suministro otorga al gobierno estadounidense la autoridad de exigir a sus contratistas que excluyan al proveedor designado de cualquier actividad relacionada con contratos federales. El punto técnico-legal más crítico —y que los equipos jurídicos de Microsoft y Google analizaron de forma inmediata— es el alcance exacto de esa exclusión. ¿Aplica a toda actividad de un contratista del Pentágono, o únicamente a los proyectos directamente vinculados a contratos del Departamento de Defensa? La respuesta define si miles de empresas Fortune 500, que simultáneamente son contratistas de defensa y usuarios de Claude para operaciones comerciales, deben desinstalar el modelo de sus sistemas por completo.

La posición de Dario Amodei: una defensa con precisión quirúrgica

El director ejecutivo de Anthropic, Dario Amodei, respondió con un comunicado de notable precisión legal. Citó textualmente que la designación “aplica únicamente al uso de Claude por parte de clientes como parte directa de contratos con el Departamento de Guerra, no a todo uso de Claude por clientes que tengan dichos contratos.” Esta distinción es fundamental. Amodei argumenta que incluso los contratistas de defensa pueden continuar utilizando Claude para sus operaciones comerciales no relacionadas con sus contratos específicos con el Pentágono. La estrategia es clara: aislar el conflicto al perímetro estrictamente militar, protegiendo el volumen masivo de negocio empresarial y comercial de Anthropic.

La Respuesta de Microsoft, Google y Amazon: Garantías para el Mercado Empresarial

La velocidad con la que los tres gigantes tecnológicos emitieron sus declaraciones de respaldo revela la magnitud del riesgo comercial percibido. Microsoft fue la primera en actuar. Un portavoz de la compañía confirmó a TechCrunch que sus equipos legales revisaron la designación y concluyeron que “los productos de Anthropic, incluyendo Claude, pueden permanecer disponibles para nuestros clientes —salvo el Departamento de Guerra— a través de plataformas como Microsoft 365, GitHub y el Marco de IA de Microsoft”.

Esto tiene implicaciones directas para cualquier organización que use las herramientas de productividad o desarrollo de software de Microsoft e integre Claude en sus flujos de trabajo. En 2026, se estima que más de 3 millones de organizaciones globales acceden a modelos de inteligencia artificial a través de la infraestructura en la nube de Microsoft, Google o Amazon. El riesgo de una interrupción masiva del servicio habría sido catastrófico para la adopción empresarial de la inteligencia artificial a nivel mundial.

Google siguió la misma línea con una declaración espejo: “Entendemos que la Determinación no nos impide trabajar con Anthropic en proyectos no relacionados con la defensa, y sus productos permanecen disponibles a través de nuestras plataformas, como Google Cloud.” Amazon Web Services confirmó de forma similar que sus clientes y socios pueden continuar utilizando Claude para cargas de trabajo no asociadas a la defensa.

Para los ejecutivos de tecnología que leen esto desde México o América Latina, el mensaje es inequívoco: si su organización usa Claude a través de plataformas en la nube de estos tres proveedores para automatización empresarial, análisis de datos o desarrollo de software, la operación continúa sin interrupciones. Consulta nuestras herramientas de IA recomendadas para evaluar qué plataforma se adapta mejor a tu ecosistema tecnológico.

El perímetro exacto de la exclusión: quién queda fuera y quién no

La arquitectura legal que emerge de las declaraciones de los tres proveedores dibuja un perímetro muy específico. Quedan excluidos del acceso a Claude: el propio Departamento de Defensa de los Estados Unidos, y los contratistas de defensa únicamente cuando usan Claude como herramienta directa dentro de un contrato específico con el Pentágono. Quedan expresamente incluidos en el acceso continuo: empresas privadas sin contratos de defensa, organismos gubernamentales no militares, contratistas de defensa en sus operaciones comerciales no relacionadas con el Pentágono, y consumidores individuales. Esta distinción quirúrgica minimiza el daño comercial, pero crea una capa de complejidad de cumplimiento normativo para las empresas que operan en ambas esferas simultáneamente.

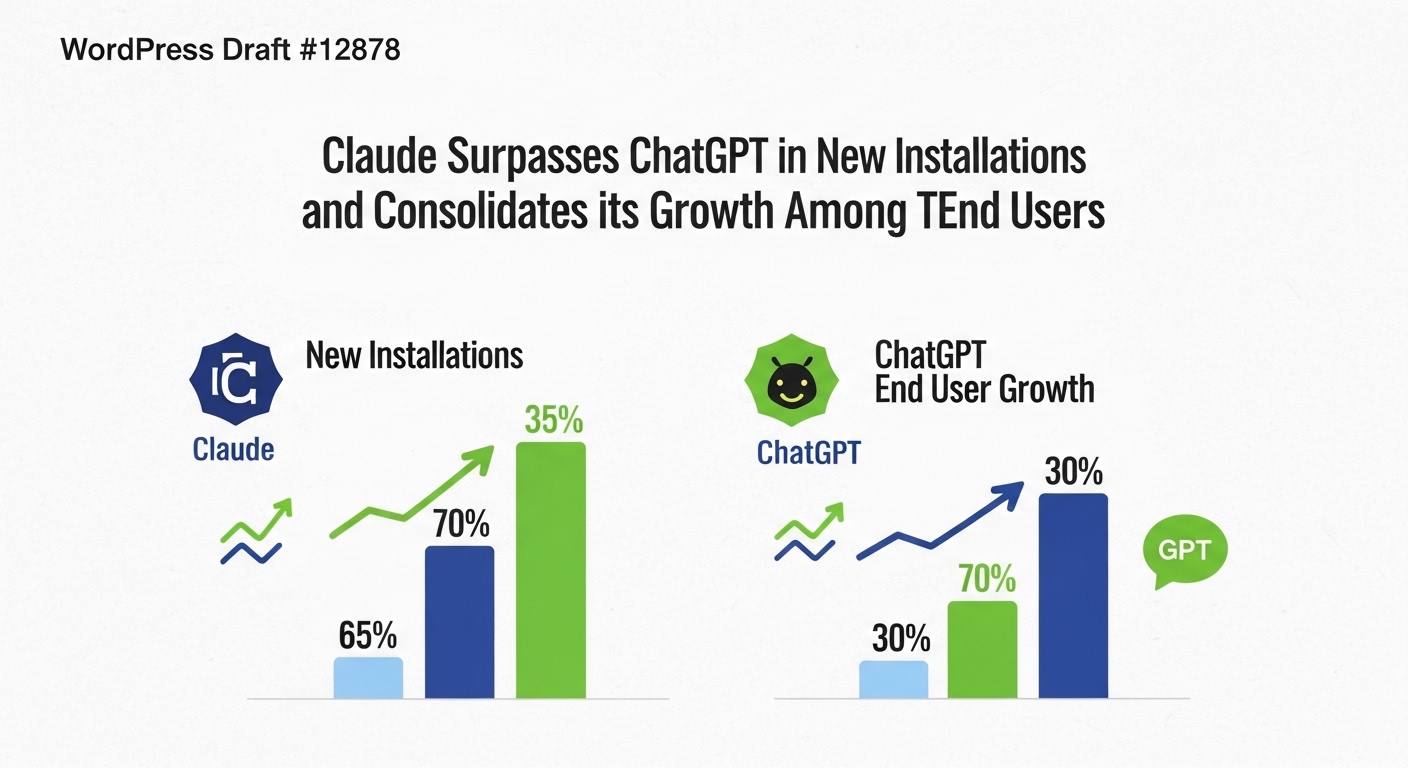

El efecto rebote: el crecimiento de usuarios de Claude se acelera

En un giro irónico que los analistas de mercado ya estaban anticipando, la crisis no solo no dañó la adopción de Claude, sino que la aceleró. Mientras las desinstalaciones de ChatGPT aumentaron un 295% tras el anuncio del acuerdo entre OpenAI y el Departamento de Defensa, Anthropic reportó un aumento sostenido en el crecimiento de usuarios de Claude. El rechazo público de Anthropic a colaborar en vigilancia masiva y armas autónomas se convirtió en un diferenciador de marca de valor incalculable para un segmento significativo del mercado: empresas de tecnología, organizaciones de medios, firmas legales y startups que priorizan la alineación ética de sus proveedores de inteligencia artificial. Puedes revisar el análisis detallado de este fenómeno en nuestras noticias de IA más recientes.

Impacto Estratégico para Empresas en México y América Latina

Para los directores de tecnología y directores ejecutivos de organizaciones latinoamericanas, este episodio no es solo ruido geopolítico del norte. Es una señal de mercado con consecuencias directas sobre la estrategia de adopción de inteligencia artificial en sus empresas. Tres decisiones inmediatas deben estar sobre la mesa de todo líder tecnológico en este momento.

Primero, la diversificación de proveedores de modelos de lenguaje deja de ser una buena práctica optativa y se convierte en imperativo operacional. Depender de un único modelo de inteligencia artificial expone a tu organización a interrupciones por causas completamente ajenas a tu control, ya sean geopolíticas, regulatorias o éticas.

Segundo, la elección del proveedor de nube como intermediario tiene valor estratégico nuevo. Microsoft, Google y Amazon demostraron esta semana que actúan como escudos contractuales que aíslan a sus clientes empresariales de conflictos entre el modelo de inteligencia artificial subyacente y los gobiernos. Esta función de amortiguación tiene un valor real que debe incorporarse al análisis de costos y beneficios de cualquier estrategia de nube.

Tercero, la ética como criterio de selección de proveedores adquiere peso comercial tangible. La postura de Anthropic generó lealtad de marca y aceleró su crecimiento precisamente al rechazar un cliente gubernamental poderoso. Las organizaciones que evalúan qué herramientas de inteligencia artificial integrar deben ahora incluir formalmente la política ética del proveedor como variable de riesgo en su proceso de diligencia debida. Si quieres profundizar en cómo otras empresas están cerrando su brecha en la adopción de IA, revisa nuestro análisis del informe del MIT sobre la brecha operativa de IA en empresas.

La nueva geopolítica de la inteligencia artificial y sus efectos regulatorios globales

Este conflicto inaugura formalmente una nueva categoría de riesgo que los marcos regulatorios globales aún no habían contemplado: el riesgo de designación soberana de un proveedor de inteligencia artificial. Si el gobierno más poderoso del planeta puede declarar a una empresa de inteligencia artificial como riesgo de cadena de suministro por razones éticas —no por espionaje, no por origen extranjero, sino por negarse a facilitar armas autónomas—, entonces cualquier gobierno del mundo tiene ahora un precedente para ejercer control similar sobre sus mercados de inteligencia artificial. Para las organizaciones que operan en múltiples jurisdicciones, esto eleva significativamente la complejidad del cumplimiento normativo de inteligencia artificial de cara a 2027.

Qué deben hacer los equipos de tecnología empresarial esta semana

Las acciones concretas son tres. Primero, audita tu uso actual de modelos de inteligencia artificial de terceros e identifica a través de qué plataforma los consumes: directamente vía interfaz de programación de aplicaciones del proveedor, o mediado por un proveedor de nube como Microsoft, Google o Amazon. La distinción determina tu exposición al riesgo regulatorio. Segundo, revisa los contratos de servicio de tus proveedores de nube para confirmar las cláusulas de continuidad de servicio en escenarios de litigio regulatorio como el que enfrenta Anthropic hoy. Tercero, si tu organización tiene contratos con dependencias gubernamentales en cualquier país, establece un protocolo de revisión periódica de las designaciones regulatorias de tus proveedores de inteligencia artificial. Para implementar una estrategia de adopción de IA sin estas vulnerabilidades, el equipo de iamanos.com está disponible para guiarte en cada paso del proceso.

El Precedente Jurídico: Anthropic Lleva el Caso a los Tribunales

Anthropic no se quedó en declaraciones. La compañía anunció formalmente que impugnará la designación en los tribunales estadounidenses, lo que convierte este conflicto en un caso de litigio de alto perfil que definirá los límites legales del poder ejecutivo sobre empresas privadas de inteligencia artificial. Los argumentos jurídicos que Anthropic previsiblemente presentará son de enorme relevancia: ¿puede el Ejecutivo estadounidense aplicar una categoría regulatoria diseñada para adversarios extranjeros a una empresa nacional como mecanismo de coerción para obtener acceso a tecnología que el proveedor considera insegura? La respuesta de los tribunales trazará una línea que determinará el equilibrio de poder entre el Estado y las empresas de inteligencia artificial durante la próxima década.

De cara a 2027, la predicción más sólida es que este litigio producirá una nueva doctrina legal sobre los derechos de los proveedores de inteligencia artificial a establecer límites de uso, creando un marco que los legisladores de la Unión Europea y América Latina adoptarán como referencia para sus propias regulaciones nacionales.

Si quieres entender cómo la cadena de pensamiento de los modelos de razonamiento se convierte también en objeto de auditoría y control por parte de los gobiernos, revisa nuestro análisis sobre el control de la cadena de pensamiento en modelos de razonamiento que publicamos recientemente.

Puntos Clave

Lo que ocurrió esta semana entre el Pentágono, Anthropic, Microsoft, Google y Amazon no es una anécdota de política tecnológica estadounidense. Es el primer ensayo global de lo que será la gobernanza de la inteligencia artificial en la próxima década: una tensión permanente entre los usos que los Estados quieren habilitar y los límites que las empresas de inteligencia artificial están dispuestas a tolerar. Para los líderes empresariales en México y América Latina, la lección operativa es clara: la ética de tu proveedor de inteligencia artificial es ahora un factor de riesgo financiero y regulatorio, no solo una declaración de principios en su sitio web. La continuidad de tus operaciones depende de entender exactamente a través de qué capa tecnológica consumes inteligencia artificial y qué protecciones contractuales te resguardan cuando los conflictos entre gobiernos y empresas de IA inevitablemente escalen. En iamanos.com construimos estrategias de adopción de inteligencia artificial que consideran exactamente estas variables. No esperes a que la crisis llegue a tu industria para actuar.

Lo que necesitas saber

Sí. La designación de riesgo del Departamento de Defensa de los Estados Unidos aplica exclusivamente a contratos directos con ese organismo militar. Las empresas mexicanas y latinoamericanas que usan Claude a través de Microsoft, Google Cloud o Amazon Web Services no están afectadas y pueden continuar operando con normalidad.

Es una categoría regulatoria del gobierno estadounidense que históricamente se aplicaba a empresas extranjeras sospechosas de espionaje o compromisos de seguridad nacional. Obliga a los contratistas federales a certificar que no usan al proveedor designado en sus actividades bajo contrato con el gobierno. Es la primera vez en la historia que se aplica a una empresa emergente de inteligencia artificial de origen estadounidense.

Porque el rechazo público de Anthropic a facilitar vigilancia masiva y armas autónomas generó una percepción positiva de marca entre empresas y desarrolladores que priorizan la alineación ética de sus proveedores de IA. Simultáneamente, las desinstalaciones de ChatGPT aumentaron un 295% tras el anuncio del acuerdo de OpenAI con el Departamento de Defensa, lo que derivó tráfico significativo hacia Claude.

Deben auditar si sus contratos gubernamentales incluyen cláusulas que exijan certificación de no uso de Anthropic. Si los contratos son con entidades no militares —como ministerios de salud, educación o finanzas— no existe obligación de descontinuar el uso de Claude. Si tienen contratos con dependencias de defensa en cualquier país, deben consultar a sus equipos legales para evaluar el alcance de sus obligaciones de cumplimiento normativo.

El litigio tiene el potencial de establecer un precedente jurídico que defina los límites del poder ejecutivo sobre empresas privadas de inteligencia artificial. Si Anthropic gana, se consolida el derecho de los proveedores de IA a rechazar contratos que consideren éticamente incompatibles con sus políticas de uso seguro. Este precedente influiría directamente en los marcos regulatorios de inteligencia artificial en la Unión Europea y América Latina durante los próximos años.

Convierte este conocimiento en resultados

Nuestro equipo implementa soluciones de IA para empresas B2B. Agenda una consultoría gratuita.